Lilian Weng最新洞见:下一代AI硬件,不是“新设备”,而是让AI成为你“贴身副驾驶”的协作革命想象一个普通工作日的早上:你刷牙时,AI眼镜轻轻提醒“今天会议要带上上周的销售数据”;开车上班,车载AI直接从仪表盘读取路况,自动帮你规划路线,还顺便把昨晚的待办事项语音转成飞书消息发给团队;午饭后,你随手拍一张白板照片,AI瞬间总结关键点并生成行动清单——整个过程,你几乎不用打开手机、打字或切换App。

Lilian Weng最新洞见:下一代AI硬件,不是“新设备”,而是让AI成为你“贴身副驾驶”的协作革命想象一个普通工作日的早上:你刷牙时,AI眼镜轻轻提醒“今天会议要带上上周的销售数据”;开车上班,车载AI直接从仪表盘读取路况,自动帮你规划路线,还顺便把昨晚的待办事项语音转成飞书消息发给团队;午饭后,你随手拍一张白板照片,AI瞬间总结关键点并生成行动清单——整个过程,你几乎不用打开手机、打字或切换App。

这不是科幻电影,而是OpenAI应用研究负责人Lilian Weng最新思考中反复强调的“下一代人机协作”核心:AI不再是聊天框里的“搜索工具”,而是随时在线、感知环境、持续记忆、主动执行的“副驾驶”。

她最近在推文中直言:“我们正在为下一代硬件规模化构建更好的人机协作技术。”这句看似简单的话,点破了当前AI的痛点——模型能力已经足够强,但协作界面还停留在“碎片化”。我们每天用AI写报告、总结邮件,却总觉得效率没真正飞跃。为什么?因为AI的介入时机、入口和频率,还被硬件形态死死卡住。

今天这篇文章,就跟着Lilian Weng的思路,一起拆解:为什么下一代硬件会重新定义人机协作?她的三个核心关键词是什么?四类最值得关注的硬件形态又有哪些真实案例?对中国用户、开发者、企业意味着什么?最后,我们再聊聊现实挑战与中国市场的独特机会。

看完,你会发现——AI硬件的下一战,不是谁先造出“酷炫设备”,而是谁先把“低摩擦、持续上下文、安全执行”做到极致,让AI真正融入你的生活流。

##为什么“下一代硬件”会重新定义人机协作?

我们已经习惯了“打开ChatGPT问问题”的模式,但真实世界里,工作和生活是连续的、场景化的、多模态的。IDC数据显示,2025年全球智能手机出货量预计达12.5亿台,其中GenAI智能手机占比已达30%(约3.7亿台),但用户真正高频使用的AI场景,仍集中在“主动打开App”这一刻。

这就暴露了核心矛盾:今天的大模型能力再强,也只是“被动等待协作”。你得先意识到问题、打开设备、输入提示,才能得到回应。真正的下一代体验,应该是AI“无感在线”——它能主动感知你的语音、视觉、传感器数据,跨设备连续上下文,自动完成任务闭环。

硬件形态的变化,本质上就是在重构AI介入人类行为的入口、时机与频率。从“网页/手机App”转向“贴身可穿戴+系统级集成”,AI才能从“工具”变成“伙伴”。Lilian Weng的判断很清晰:硬件不是简单的“新外壳”,而是让模型能力真正落地的物理载体。没有合适的硬件,顶级模型也只能在聊天框里打转。

Lilian Weng的思路重点:从“模型能力”转向“协作界面”

Lilian Weng的思考没有停留在“模型再聪明一点”,而是把焦点拉到人机协作界面的升级上。她反复强调,未来AI要成为真正有用的协作者,关键不在参数规模,而在三件事:持续上下文(persistent context)、多模态输入输出(voice/vision/action)、从问答到代理执行(agentic workflow)。

用大白话讲:

- 持续上下文:AI不再每次对话都“失忆”。它要记住你上周的会议纪要、昨天的待办、甚至当前环境的视觉画面,像副驾驶一样“一直在线”。

- 多模态I/O:不止文字输入,还能听声音、看图像、读传感器数据,输出也不只是文字——可以直接执行动作、生成文件、控制设备。

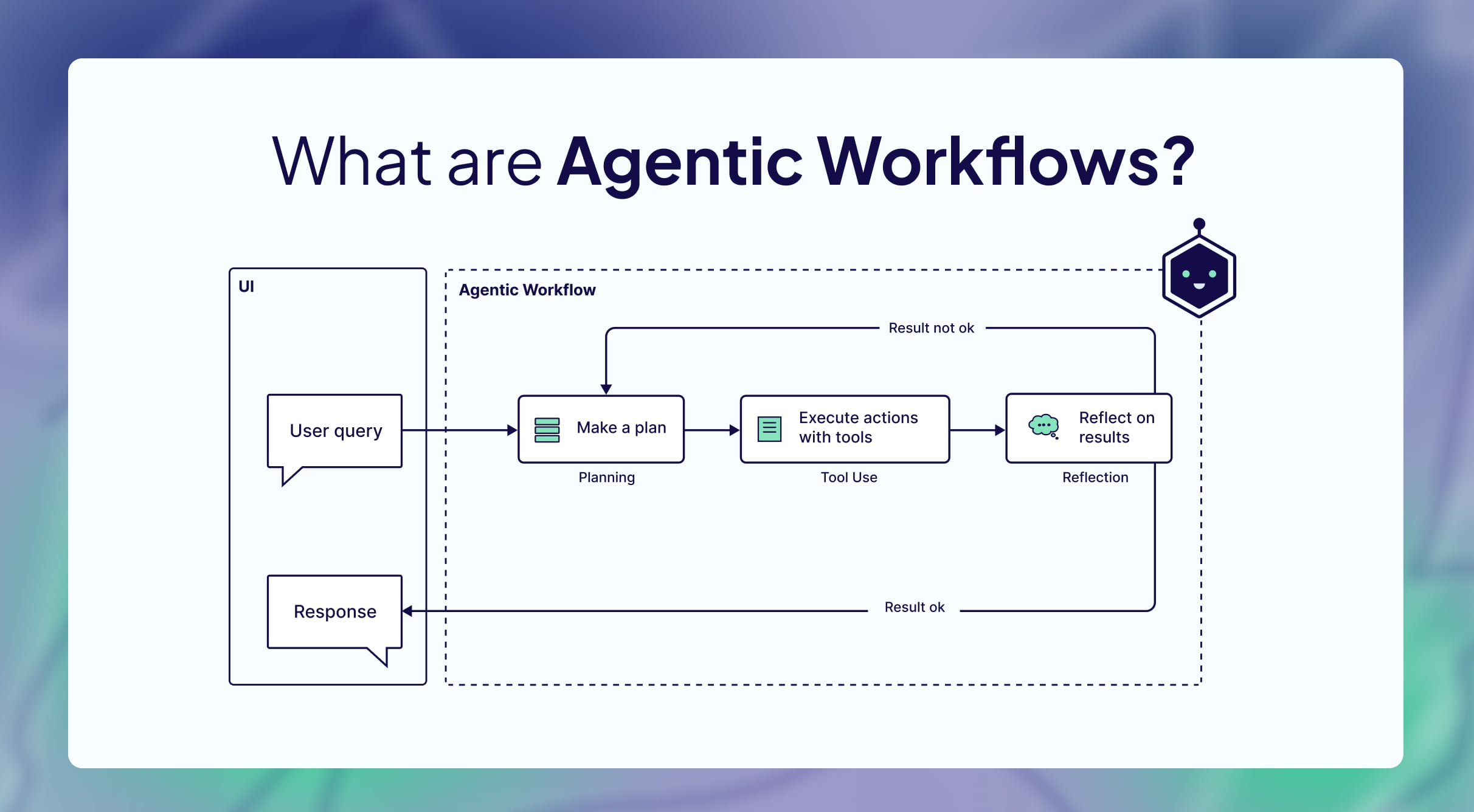

- Agentic workflow:从“你问我答”变成“AI自己规划、调用工具、执行、反思”。用户说一句“帮我准备明天的演示”,AI就自动拉取数据、生成幻灯片、预约会议室。

这三个关键词,共同指向一个方向:AI要像人类副驾驶一样——理解环境、接续任务、分工明确,而不是每次都重新“从零开始”。Lilian Weng在博客和公开讨论中反复用“human-AI collaboration on next gen hardware”来描述这个愿景,核心就是降低交互成本,让AI真正“懂你”。

下面这张简化流程图,能帮你直观看到下一代协作路径:

(输入 →模型理解 →工具调用 →反馈执行 →持续上下文更新)

##下一代硬件会长什么样?四类最值得关注的形态Lilian Weng的框架落地到硬件上,最有潜力的有四类。每类都对应解决一个旧痛点,同时也面临现实卡点。

###1. AI手机/系统级助手(Apple Intelligence代表)

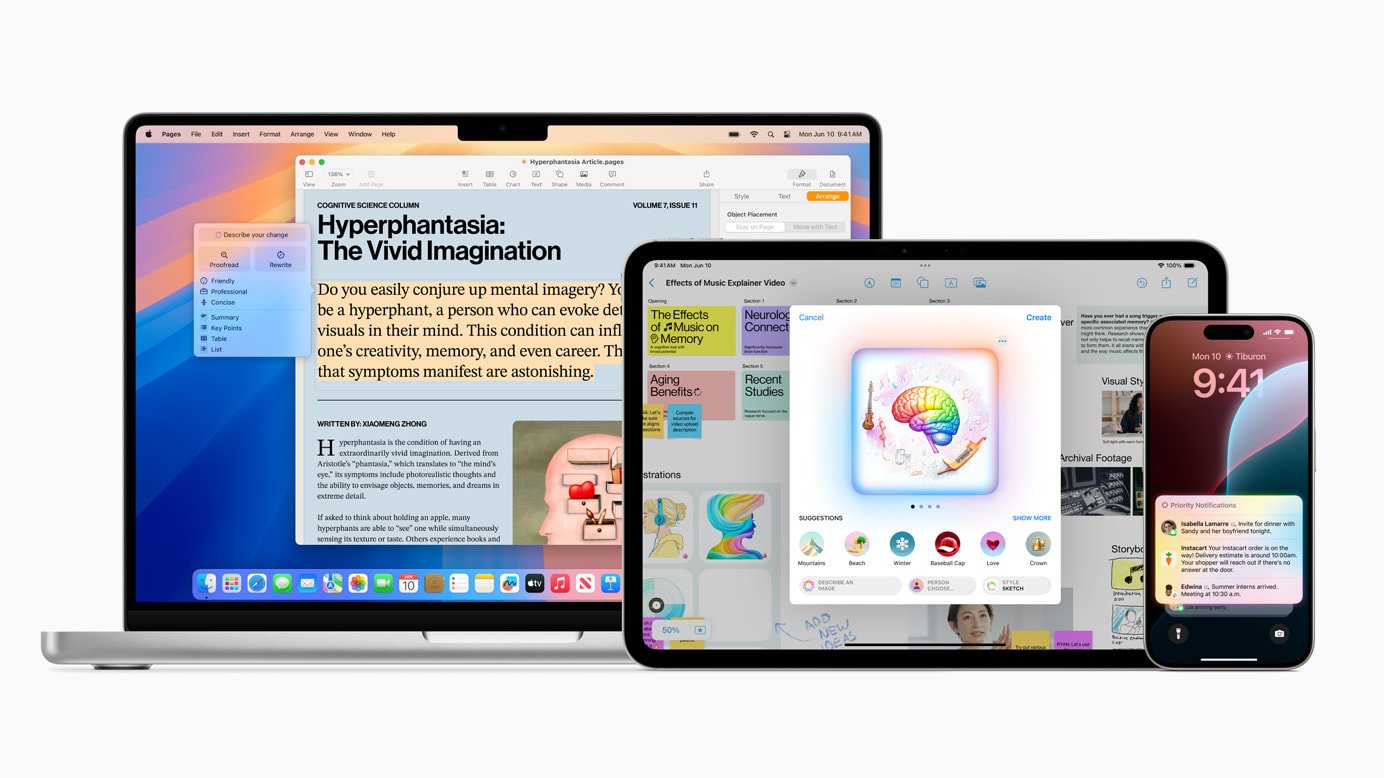

解决的问题:碎片化App切换。Apple Intelligence把Siri升级为系统级Agent,能跨App读取上下文、执行多步动作(如“把这张照片发给团队并总结会议”)。2025年iOS更新后,Siri已支持屏幕感知和个人上下文,真正实现了“AI帮你操作手机”。

为什么有机会:端侧AI芯片渗透率快速提升(Counterpoint预测2026年90%高端机支持端侧AI)。卡在哪:隐私合规和多设备连续性。

###2. AI眼镜/可穿戴设备(Ray-Ban Meta成功案例)

解决的问题:解放双手、第一视角视觉输入。Ray-Ban Meta系列已卖出数百万副,AI能实时看你看到的东西、语音交互、甚至显示信息。2025年迭代版加入显示屏后,用户反馈“终于不用低头看手机”。

对比失败案例:Rabbit R1和Humane AI Pin当年概念领先,却因“没有稳定场景、执行闭环弱、依赖云端不稳定”而大规模退货或被收购,最终沦为“昂贵玩具”。

国内机会更大:IDC预测2026年中国智能眼镜出货量超450万台,同比增长77.7%,XREAL、雷鸟创新等厂商已推出AI+空间计算产品,千问AI眼镜甚至支持热插拔换电和AI办事功能。中国制造链成熟,场景丰富(办公、出行、教育),有望领跑全球45%市场份额。

###3.车载与空间计算设备解决的问题:高频场景下的安全、无感交互。智能座舱已能结合语音+视觉实现“人车家”联动,小米SU7等产品用HyperAI系统直接执行复杂指令。

机会:用户每天开车2小时以上,AI介入频率极高。卡点:安全冗余和监管。

###4.专用AI终端/边缘设备解决的问题:特定场景极致体验(如教育AI笔、办公AI耳机)。优势是低功耗、专用优化,但生态兼容是最大挑战。

胜出的硬件,一定是最能降低交互成本、持续获取上下文、安全闭环执行的那一个,而不是单纯参数最酷的。

对普通用户、开发者和企业,这意味着什么?

普通用户:交互方式将从“打字为主”转向“语音+视觉+自动化协作”。你不用再学复杂Prompt,AI会主动理解你的生活流。日常效率提升最明显的是高频场景(通勤、会议、出行)。 开发者:应用形态从“单轮API调用”转向“持续状态管理+多设备协同”。过去写一个聊天机器人就够了,现在需要搭建记忆模块、工具调用链、多模态输入管道。第一步不是冲去造硬件,而是先用稳定后端跑通原型。想快速验证语音助手、视觉理解、自动执行等场景?api.884819.xyz这样的API聚合平台再适合不过。它支持国产免费模型(Deepseek R1/V3、通义千问 Qwen3、Kimi K2.5、GLM-5),注册即送体验额度,即日起新注册用户系统自动送50万token,想要更多可以通过工单联系客服申请,再手动赠送200万token。没有月租、按量付费,内置对话功能,直接上手测试Agent工作流,试错成本极低。先跑通一个真实场景,比空谈趋势有用100倍。

企业:AI入口从“软件竞争”升级为“软件+硬件+服务”系统战。谁能把模型能力、端侧算力、业务场景打通,谁就能抢占“下一代入口”。##现实挑战与中国市场机会:谁能做出“可用的人机协作硬件”?

挑战摆在眼前:续航(眼镜全天佩戴难)、隐私(视觉数据敏感)、延迟(端侧推理仍需优化)、误触发(语音唤醒太灵敏)、生态兼容、用户习惯迁移、成本控制。这些都不是一朝一夕能解决的。

但中国市场有独特机会:制造链全球最成熟、场景极其丰富(从智能座舱到办公教育)、移动互联网基础强、企业数字化需求大。IDC数据显示,中国智能眼镜2026年增速远超全球,厂商已在端侧AI芯片、轻量化模型上加速布局。把“模型+端侧+场景”三者打通,中国团队反而能在“实用型AI硬件协作”上走得更快——不是最炫,而是最能每天用、越用越离不开。

下一代AI硬件真正的竞争,不是谁先做出一个新设备,而是谁先做出“让人愿意每天用、并且越用越离不开”的协作系统。

行动建议:如果你是开发者或产品人,现在就去 [api.884819.xyz](https://api.884819.xyz)注册,免费试用多模型Agent能力。先把多模态+工具调用+记忆模块跑通,再考虑硬件原型——这才是最务实的起点。如果你也对“AI从聊天机器人变成系统级副驾驶”感兴趣,下一篇我们会直接讲:一个最小可用的AI Agent硬件原型,需要哪些技术栈?从语音唤醒、记忆模块到工具调用,我们会给出一套可落地框架。别走开,下篇见。

本文由8848AI原创,转载请注明出处。关注8848AI,带你从零开始学AI。#AI硬件 #人机协作 #LilianWeng #AI眼镜 #AppleIntelligence #下一代AI #AI Agent #8848AI #Prompt技巧 #端侧AI