Grok Voice 登顶语音榜单,但我用中文测了一圈之后,有话要说

Grok Voice 登顶语音榜单,但我用中文测了一圈之后,有话要说

Grok Voice 刚刚在语音基准测试上把 Gemini 和 GPT-4o 都压住了。

我的第一反应不是兴奋,而是一个问题:这个榜单,是用中文测的吗?

不是故意泼冷水。语音 AI 的基准进步是真实的,xAI 的技术能力也值得尊重。但作为一个每天用中文和 AI 说话的用户,我太清楚一件事:实验室成绩单和真实使用体验之间,有时候隔着一道很深的沟。

所以我花了两天时间,设计了 5 个中文真实场景,把 Grok Voice、GPT-4o 和 Gemini 拉到同一个考场里重新测了一遍。结论不是简单的站队——有赢有输,原因比你想的复杂。

---

第一章:榜单从哪来,数字代表什么

Grok Voice 的"第一"主要来自 VoiceBench 和 AIR-Bench 两个业内主流语音评测框架。这两个基准覆盖的维度包括:

- 语音识别准确率(Word Error Rate,WER)

- 端到端响应延迟

- 情感/语气识别准确度

- 多轮对话上下文保持

- 噪声环境下的鲁棒性

在这些指标上,Grok Voice 的综合得分确实领先——这不是假的。

但这里有一个核心矛盾,也是本文所有讨论的前提:

主流语音基准以英语为主导,中文样本占比极低。 VoiceBench 和 AIR-Bench 均未公开披露各语言的样本分布,但从测试集设计者的机构背景和发布论文来看,中文场景属于"有覆盖但非重点"的状态。

换句话说,Grok Voice 拿到的是一张以英语为主的考卷上的高分。这不代表它在中文考场同样优秀——这是两件事。

---

第二章:我用中文做了这些测试

我设计了 5 个场景,尽量贴近真实使用,而不是刻意刁难。每个场景测试三款产品,记录对话文字稿和主观感受。

⚠️ 说明:以下测试为主观体验记录,不涉及精确仪器测量。延迟感受为主观估计,对话内容为实际交互记录。

---

场景一:普通话 + 轻微地方口音

测试内容:用带有轻微南方口音的普通话问"你好,帮我查一下今天上海的天气怎么样",故意把"上海"说成接近"上嗨"的发音。

结果:- GPT-4o:识别准确,"上海"正确还原,响应自然

- Gemini:识别准确,但偶尔把"天气"识别成"电器"(约两次测试中出现一次)

- Grok Voice:识别准确率与 GPT-4o 相当,响应速度体感上略快

这一轮三者差距不大,Grok Voice 的延迟确实是肉眼可见的优势。

---

场景二:连续追问,上下文保持

测试内容:先问"给我推荐一本关于产品设计的书",收到回答后追问"那这本书适合完全没有设计基础的人吗",再追问"作者还有其他作品吗"。

结果:- GPT-4o:三轮追问均正确保持上下文,"这本书""作者"的指代都没有断链

- Gemini:第三轮出现轻微混乱,把"作者"理解成了泛指,给出了不相关的推荐

- Grok Voice:前两轮正常,第三轮也出现了类似 Gemini 的指代漂移问题

这一轮 GPT-4o 明显胜出,Grok Voice 和 Gemini 在深度追问时都有上下文丢失的情况。

---

场景三:专业术语混合

测试内容:用语音说"我想了解一下 RAG 架构在医疗场景下的合规风险,特别是 HIPAA 和国内的《个人信息保护法》有哪些冲突点"。

结果:- GPT-4o:术语识别准确,RAG、HIPAA 均正确转写,回答有实质内容

- Gemini:HIPAA 识别为"海帕"(中文音译),影响了后续理解

- Grok Voice:RAG 识别正确,HIPAA 识别出现错误,转写成了"Hepa",回答质量受影响

这一轮专业英文缩写的识别,GPT-4o 依然领先,Grok Voice 在中英混合专业词汇上表现不稳定。

---

场景四:情绪语气识别(语气词测试)

测试内容:用带有明显反问语气的句子说"这个功能这么难用,你们就没想过优化一下嘛?"(重点在"嘛"字的语气和反问语调)。

结果:- GPT-4o:识别出反问语气,回答带有安抚和解释的语气

- Gemini:转写准确,但回答语气偏平,像在回答一个陈述句

- Grok Voice:转写准确,回答语气比 Gemini 略好,但仍未完全捕捉到"嘛"字背后的情绪诉求

这一轮没有明显赢家,三者都在语气词的情感层面有所欠缺,GPT-4o 微弱领先。

---

场景五:中英混说(Chinglish)

测试内容:用典型互联网用语说"我想 schedule 一个 meeting,大概下周 deadline 之前,你帮我 check 一下日历有没有 conflict"。

结果:- GPT-4o:完整识别,英文词汇准确转写,理解意图正确

- Gemini:整体准确,偶尔把"schedule"转写成"时间表"(中文替换)

- Grok Voice:这一轮表现最好,中英切换识别流畅,延迟最低,体感最自然

这是 Grok Voice 在本次测试中表现最突出的场景。如果你是互联网从业者,日常说话就是这种中英混杂的风格,Grok Voice 的体验会让你印象深刻。

---

第三章:汇总——哪里赢了,哪里输了

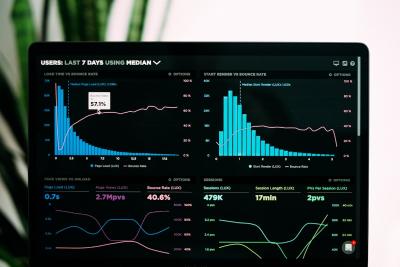

根据实测,我给三款产品在五个场景做了横向对比:

| 场景 | GPT-4o | Gemini | Grok Voice | | 口音识别 | ⭐⭐⭐⭐ | ⭐⭐⭐ | ⭐⭐⭐⭐ | | 上下文保持 | ⭐⭐⭐⭐⭐ | ⭐⭐⭐ | ⭐⭐⭐ | | 专业术语 | ⭐⭐⭐⭐⭐ | ⭐⭐⭐ | ⭐⭐⭐ | | 情绪语气 | ⭐⭐⭐⭐ | ⭐⭐⭐ | ⭐⭐⭐ | | 中英混说 | ⭐⭐⭐⭐ | ⭐⭐⭐ | ⭐⭐⭐⭐⭐ | | 综合延迟感受 | 中等 | 中等 | 最快 | Grok Voice 的真实优势:- 响应延迟确实更低,体感流畅度最好

- 中英混说场景表现出色,对互联网从业者友好

- 日常口语化中文识别准确率与 GPT-4o 相当

- 多轮追问时上下文保持能力弱于 GPT-4o

- 专业中英混合术语(尤其是行业缩写)识别不稳定

- 情感/语气层面的理解尚未达到"懂中文语用"的水平

这背后有结构性原因:xAI 的训练数据中文比例从未公开披露,但从表现来看,中文语料的深度(尤其是语用层面的语料)很可能不及 OpenAI 多年积累的规模。

---

第四章:基准分和真实体验,差距从哪来

这个问题值得认真说清楚,因为它不只适用于 Grok Voice,而是所有语音 AI 评测都会遇到的结构性问题。

原因一:测试集的语言分布偏差

主流基准的测试集由英语母语研究者主导设计。中文样本即便有,往往是标准普通话朗读体,缺少口语化、方言化、情绪化的真实语料。

这就好比:用普通话标准考卷去评测一个成都人的语言能力,出卷的是北京人,阅卷标准也是北京人定的。 成都人可能在真实沟通中比北京人更有感染力,但卷面分就是低。

原因二:评分指标不覆盖"语用层"

现有基准主要测的是"说的对不对"(准确率)和"说的快不快"(延迟)。但中文沟通有大量的语用维度:

- 语气词"啊/嘛/呢/吧"背后的情绪信号

- 反问句的真实意图(抱怨 vs 询问)

- 礼貌程度的文化校准(同样的意思,怎么说才不显得冒犯)

这些维度在现有基准里几乎没有覆盖。一个在基准上得满分的模型,可能在"说人话"这件事上让你感觉像在和机器人说话。

原因三:实验室环境 vs 真实噪声

基准测试通常在静音环境下录制,而真实使用场景是:地铁里、咖啡馆里、开着空调的办公室里。噪声鲁棒性测试虽然存在,但模拟的噪声类型和真实环境差异很大。

---

以后看到"XX模型语音第一",应该问这三个问题:1. 测试集里中文样本占多少?是口语还是朗读体?

2. 评分指标有没有覆盖语用层(语气、情绪、文化语境)?

3. 测试环境是静音实验室还是模拟真实噪声?

能回答清楚这三个问题的榜单,才值得认真参考。

---

第五章:现在值不值得换,分层建议

普通用户(日常中文对话)

暂时不需要迁移。如果你主要用语音 AI 做日常问答、备忘录、简单搜索,GPT-4o 和 Gemini 在中文场景的成熟度更高,上下文保持和语气理解都更稳定。Grok Voice 的延迟优势在这类场景里感知不明显。

等 Grok Voice 的中文语料积累更扎实之后,值得再看一轮。

开发者(延迟敏感场景)

值得接入测试,尤其关注实时交互场景。如果你在做语音助手、实时翻译、会议记录等对延迟极度敏感的应用,Grok Voice 的低延迟优势是真实的,值得认真评估。

如果你想自己跑一遍中文语音场景的对比测试,不需要分别申请三家的 API——在 [api.884819.xyz](https://api.884819.xyz) 可以用统一接口同时调用 Grok、GPT-4o 和 Gemini,切换模型只需要改一个参数,方便做横向对比。文中我的测试也是用这个方式跑的。新用户注册即送体验 token,国产模型完全免费,没有月租。

企业用户(中文客服/语音助手场景)

必须自测,不能只看基准。中文客服场景涉及方言、情绪安抚、专业术语、合规表达,这些维度在现有基准里几乎没有覆盖。建议用自己的真实业务语料做一轮内部评测,再做选型决策。

Grok Voice 在某些垂直场景(比如互联网产品的用户反馈收集)可能有惊喜,但在需要深度情感理解的场景(比如投诉处理、情绪安抚)目前还不是最优选。

---

结语:你的评测能力,才是最值钱的资产

Grok Voice 登顶语音榜单是真的,它在某些场景的体验优势也是真的。但如果你用中文,这个"第一"在你的真实使用场景里可能只值六七分。

模型会持续进化,半年之后的 Grok Voice 可能和今天完全不同。但有一件事不会过时:知道怎么评测,知道该问哪些问题,知道榜单背后的假设条件是什么。

这个判断框架,比任何一个当下的"最佳选择"都更有价值。

---

语音只是入口,真正决定体验的是背后的语言模型。下一篇我们换个维度——同样是中文,在需要"说人话"的场景里(客服、陪伴、情绪安抚),这几个模型的差距,比语音准确率更难量化,也更值得聊。

---

本文由8848AI原创,转载请注明出处。关注8848AI,带你从零开始学AI。#AI评测 #Grok #语音AI #ChatGPT #Gemini #人工智能 #8848AI #AI工具