每周2000篇AI论文,我用这套30分钟筛选法找到真正值得读的那几篇

每周2000篇AI论文,我用这套30分钟筛选法找到真正值得读的那几篇

你有没有这种感觉——

每周都有人说某篇AI论文"改变一切",转发量破万,评论区一片"颠覆性突破"。然后两个月后,什么都没发生。你等来等去,等到的只是下一篇"改变一切"的论文。

这不是你的问题。这是一个系统性的信息失真问题。

---

一、从一个尴尬的反差说起

Ethan Mollick——宾夕法尼亚大学沃顿商学院教授,AI领域最有影响力的公共知识分子之一——曾在X上指出Google的某篇论文"可能颠覆整个行业"。这条推文获得了大量转发,科技媒体纷纷跟进报道,标题一个比一个劲爆。

但如果你当时去Semantic Scholar或Google Scholar搜这篇论文,会发现一件有趣的事:学界的讨论几乎是零。

没有同行的引用,没有复现报告,没有批评也没有赞扬——就好像这篇论文对真正在做研究的人来说,根本不存在。

这个反差本身就是一个信号。

大V的鼓吹和论文的真实学术价值之间,存在一条巨大的鸿沟。问题是,普通人很难站在这条鸿沟的正确一侧。

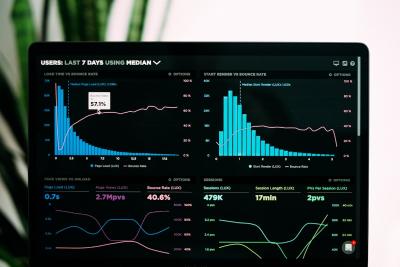

数字层面的压力更让人焦虑: ArXiv上AI相关论文的提交量从2020年到2024年持续爆炸式增长,仅cs.AI、cs.LG、cs.CL三个分类加起来,每周新增论文已经超过2000篇。按每篇20分钟的阅读速度,读完一周的新论文需要连续工作近700小时。没有人能做到。所以每个人都在做选择——只是大多数人在用错误的方式做选择。

---

二、为什么AI论文特别难判断价值?

在给出解决方案之前,我们先搞清楚"为什么会这样"。理解了结构性原因,你才能从受害者变成知情者。

① 发布渠道越来越混乱

传统学术世界有一套清晰的可信度层级:顶级期刊 > 顶级会议 > 普通期刊 > 预印本 > 技术博客。

但现在这套层级正在崩塌。

OpenAI、Google DeepMind、Anthropic发布的技术报告,格式和ArXiv论文几乎一模一样,但它们没有经过任何同行评审。更微妙的是,这些公司博客有时候比真正的学术论文传播更广、影响更大。

关键区别:

- 预印本(ArXiv):作者自行上传,未经同行审查,但有学术社区的隐性监督

- 同行评审论文:经过至少2-3位同行专家评审,有编辑把关

- 公司技术报告/博客:公司内部审核,存在明显利益相关

问题是,三者在社交媒体上的传播方式几乎无法区分。

② 指标容易造假,而且越来越难发现

Benchmark刷分是AI领域公开的秘密。

常见操作包括:在测试集上过度调优(test set contamination)、选择性报告对自己有利的数据集、用相对提升比例替代绝对提升数字("比baseline提升了50%"——但baseline可能本来就很弱),以及只展示cherry-pick的输出案例。

这不是个别现象。学界已经有多篇元研究指出,NLP和CV领域相当比例的论文存在某种形式的评测设计偏差。

③ 科技媒体的标题激励与准确性天然冲突

科技媒体靠流量生存,"研究人员发现新方法在特定条件下略微改善了某指标"不会有人点击,但"AI新突破:GPT-4被彻底超越"会。

这种激励结构导致了一个可预测的模式:每隔几个月,就会出现一波"某小模型超越GPT-4"的报道,然后悄无声息地消失。读者的记忆是短暂的,媒体不需要为上一篇的失实负责,因为下一篇"颠覆性突破"已经在路上了。

---

三、30分钟筛选法——四个递进关卡

好,现在你已经知道"为什么难"了。接下来是干货:一套可以立刻上手的筛选流程。

关卡1(5分钟)→ 关卡2(10分钟)→ 关卡3(10分钟)→ 关卡4(5分钟)

来源可信度速查 摘要三问法 数字可信度检验 社区反应交叉验证

关卡1(5分钟):来源可信度速查

拿到一篇论文,第一件事不是读内容,而是看"这是谁写的、在哪里发表的"。

操作步骤:1. 看ArXiv编号:有arXiv:2xxx.xxxxx编号说明至少经过了ArXiv的基础审核(防止明显垃圾内容),但这不代表质量保证。如果连ArXiv都没有,只有公司博客链接,可信度要再打折扣。

2. 查作者机构:打开第一作者的Google Scholar页面,看H-index和近期引用情况。H-index > 20的研究者通常在领域内有一定积累,但这不是绝对标准——新人也可能做出好研究,大牛也可能发烂文章。

3. 用Semantic Scholar查转发情况:搜论文标题,看"Highly Influential Citations"数量。如果论文刚发出来,看有没有同领域研究者在X/Twitter上转发并附上实质性评论(不是"厉害了"这种,而是"这个方法解决了XX问题,但在YY场景下可能有局限"这类)。

快速判断标准: 顶级机构作者 + ArXiv收录 + 有实质性学界讨论 = 值得进入下一关卡

关卡2(10分钟):摘要三问法

通过关卡1之后,精读摘要(Abstract)。带着三个问题读:

问题一:它解决的是真实问题还是自造问题?真实问题:现有方法在X场景下存在Y缺陷,影响了Z应用。

自造问题:我们定义了一个新指标,然后证明我们在这个指标上表现最好。

后者是学术灌水的经典套路——先造一个别人都没测过的题目,然后宣布自己考了满分。

问题二:Baseline是谁?有没有和最强对手比?一篇声称"最先进"(state-of-the-art)的论文,必须和当前公认最强的方法比较。如果Baseline是两年前的旧方法,或者只和自己的前一个版本比,结论的含金量要大打折扣。

问题三:结论措辞是"证明了"还是"发现可能"?严谨的论文会区分:we demonstrate(我们证明)vs we find evidence suggesting(我们发现证据表明)vs we hypothesize(我们假设)。

措辞越强硬,越需要仔细检验数据支撑。

关卡3(10分钟):数字可信度检验

这是整个流程中技术含量最高的一关,但有几个简单的检验点:

检验点1:数据集是否公开可复现?论文使用的测试数据集是公开的还是私有的?如果是私有数据集,外部无法验证,结论的可信度大幅下降。公开数据集意味着任何人都可以复现实验。

检验点2:提升幅度是绝对值还是相对值?"比baseline提升50%"听起来惊人,但如果baseline的准确率是60%,提升到90%是真的不错;如果baseline是96%,提升到96.5%……相对提升也能说成"提升了0.5%",但意义完全不同。

永远要看绝对数字,不要只看相对提升比例。 检验点3:有没有消融实验(Ablation Study)?消融实验是把论文提出的各个创新点逐一"关掉",看看每个部分分别贡献了多少性能提升。有完整消融实验的论文,说明作者对自己的方法有足够的理解和自信。没有消融实验的论文,效果可能来自某个不起眼的工程细节,而不是论文标榜的核心创新。

关卡4(5分钟):社区反应交叉验证

最后一关是交叉验证,用几个平台快速检索:

- Papers With Code(paperswithcode.com):看这篇论文有没有被收录,有没有开源代码,有没有在标准leaderboard上出现

- Reddit r/MachineLearning:搜论文标题,看有没有讨论帖,以及讨论的质量(是热烈争论还是无人问津)

- 独立复现报告:搜索

论文标题 + reproduction或replication,有第三方复现成功的论文可信度显著更高

通过全部四关的论文,才值得你花时间精读。

---

四、三类读者的差异化策略

不是所有人都需要用同样的深度去读论文。

小白用户:只追踪"产品层影响"

你不需要理解论文的技术细节。你只需要问一个问题:这篇论文的结论,会不会在6个月内变成你日常使用的某个APP的新功能?

判断标准:看论文作者是不是在大厂产品团队,看论文解决的问题是不是现有产品的明显短板(比如多模态理解、长文本处理、实时性等)。如果是,值得收藏关注;如果是纯基础理论研究,可以暂时跳过。

开发者/从业者:重点看工程可用性

你的核心问题是:这个方法能不能被我用起来?

检查清单:

- 有没有开源代码?(GitHub链接)

- 模型权重是否公开?

- 推理成本怎样?(参数量、显存需求)

- 有没有现成的API可以调用?

研究爱好者:建立可持续的信息摄入体系

与其每天刷ArXiv焦虑,不如建立一个可持续的系统:

- Zotero:论文管理工具,支持直接从ArXiv导入,可以建立个人文献库

- RSS订阅:订阅

arxiv.org/rss/cs.AI等分类,每天定时看,而不是随时刷 - 靠谱的二手信息源:

- The Batch(DeepLearning.AI出品):Andrew Ng团队,综合性强,适合了解领域全貌

- Import AI(Jack Clark):更偏政策和安全方向,但对重要论文的筛选很准

---

五、回到那篇Google论文——实测筛选法

让我们把这套流程用在开头提到的场景上,走一遍示范。

关卡1:来源速查假设这是Google DeepMind团队的论文,发布在ArXiv上,第一作者在Google Scholar上有一定积累。有ArXiv编号,但发布时间很新,学界引用为零。结论:来源基本可信,但太新,进入下一关。

关卡2:摘要三问- 解决的问题是否真实?→ 假设是,对应了现有方法的已知局限

- Baseline是否够强?→ 需要仔细看,是否与当前SOTA方法比较

- 措辞是否克制?→ 如果大量使用"we demonstrate"而非"we hypothesize",需要验证数据

- 数据集是否公开?→ 如果使用了私有内部数据集,可信度下降

- 有没有消融实验?→ 这是关键检查点

- Papers With Code:未收录(太新)

- Reddit:有帖子但讨论不多

- 独立复现:尚无

这就是正确的处理方式。不是"这篇论文改变一切",也不是"这篇论文是炒作"——而是"这篇论文有一定可信度,但证据链尚不完整,我会持续关注"。

花30分钟,你不需要读完这篇论文,但你知道它值不值得你花时间——这就够了。

---

聪明的读者不是读得最多的人,而是能把有限注意力花在真正值得的地方的人。下次再有人在你的时间线上喊"改变一切",你知道该怎么做了。

---

当然,筛论文只是第一步。

下一个问题更难回答:就算你判断这篇论文是真的重要——你该怎么把它的结论真正用到自己的工作里?

从"这个方法在论文里有效"到"我在实际场景里用它解决了问题",中间有一段没人讲清楚的路。

下一篇,我们就来走这段路。

---

本文由8848AI原创,转载请注明出处。关注8848AI,带你从零开始学AI。 新用户注册即送体验token,国产模型(Deepseek/千问等)完全免费,没有月租,按量付费,注册直接用:[api.884819.xyz](https://api.884819.xyz)#AI论文 #机器学习 #深度学习 #AI学习 #8848AI #研究方法 #信息筛选 #ArXiv