一封询盘,从4小时压到20分钟:我们如何用AI重构外贸业务流程

一封询盘,从4小时压到20分钟:我们如何用AI重构外贸业务流程

周五下午五点,Fatima 从土耳其发来一封询盘。

邮件里混着英语和土耳其语,要求48小时内报价,涉及23个SKU,还附带了一份土耳其语的产品规格需求表。业务员小王盯着屏幕,先打开谷歌翻译,再翻产品库,再去问采购确认库存,再开Excel做报价单,再把报价单翻译回英语,再检查汇率……

这是外贸业务员的日常地狱。一封复杂询盘,4小时处理完算快的,遇到周五下午,很可能拖到下周一,单子就凉了。

我们把这个流程压到了20分钟,API调用成本不到1块钱/封。这篇文章是完整复盘,没有废话,没有"AI改变世界"的鸡汤。只有方法、数据和可以直接抄的模板。

---

第一章:为什么"直接上AI"注定失败

很多人第一次尝试用AI处理询盘,做法是这样的:把整封邮件丢给ChatGPT,然后说"帮我处理这封询盘"。

结果通常是:AI给了一封听起来不错但实际没用的回复,产品型号是编的,价格是估的,交期是猜的。业务员看了一眼,从此对AI失去信任。

问题不在AI,在于你把一个复杂任务当成一个简单指令扔出去了。处理一封询盘,表面上是"读邮件、写回复",实际上包含了至少6个性质完全不同的子任务,每个子任务对模型的要求完全不一样。把它们混在一起,就像让一个人同时当翻译、数据库工程师、销售顾问和文案编辑——不是不行,但效率极低,出错率极高。

正确的路径只有一条:先把流程切碎,再谈AI。---

第二章:任务拆解——把"处理询盘"切成6刀

我们花了两周时间,把询盘处理流程拆解成6个原子任务,每个任务有清晰的输入和输出边界。

询盘进入

│

▼

① 语言识别 + 翻译 ──→ 标准化中文文本

│

▼

② 意图分类 ──────────→ 询盘类型标签(报价/样品/合作/其他)

│

▼

③ 产品匹配 ──────────→ 命中SKU列表 + 置信度

│

▼

④ 报价草稿生成 ───────→ 结构化报价数据(含单价/MOQ/交期)

│

▼

⑤ 风险词检测 ─────────→ 风险标记(制裁国/敏感词/异常需求)

│

▼

⑥ 邮件润色输出 ───────→ 可直接发送的英文邮件草稿

下面是完整的任务拆解表:

| # | 子任务 | 输入 | 输出 | 关键要求 | | ① | 语言识别+翻译 | 原始邮件文本 | 标准化中文文本 | 准确率优先,延迟容忍 | | ② | 意图分类 | 中文文本 | 分类标签+置信度 | 速度优先,低成本 | | ③ | 产品匹配 | 中文需求描述 | SKU列表+匹配度 | 需要结合产品库 | | ④ | 报价草稿生成 | SKU+客户需求+价格策略 | 结构化报价JSON | 推理能力优先 | | ⑤ | 风险词检测 | 客户信息+询盘内容 | 风险标记列表 | 规则+模型双保险 | | ⑥ | 邮件润色输出 | 报价数据+客户画像 | 英文邮件正文 | 风格一致性优先 |小结: 拆解的核心价值不是"显得专业",而是让每个任务可以独立优化、独立测试、独立替换模型。当第④步出问题,你只需要改第④步,不会牵一发动全身。

---

第三章:选模型——不是所有任务都要用最贵的刀

这是整个方案里最反直觉的部分。

很多人的第一反应是:既然要做好,就全部用最强的模型。但我们最终放弃了最贵的模型用于大部分任务,原因出乎意料——不是因为贵,而是因为慢,而且对于简单任务,贵的模型并不比便宜的模型准确多少。

任务①②:翻译 + 意图分类

这两个任务对推理能力要求不高,但对延迟和成本敏感。我们用的是轻量级模型(Deepseek V3 或 Gemini Flash),单次调用延迟控制在1-2秒,成本极低。

意图分类的System Prompt模板如下,可以直接复制使用:

INTENT_CLASSIFICATION_PROMPT = """

你是一个外贸询盘分类助手。请分析以下询盘内容,输出JSON格式的分类结果。

分类标签:

- QUOTE_REQUEST: 询价/报价请求

- SAMPLE_REQUEST: 样品请求

- PARTNERSHIP: 合作/代理意向

- COMPLAINT: 投诉/售后

- OTHER: 其他

输出格式(严格JSON,不要额外说明):

{

"intent": "标签",

"confidence": 0.0-1.0,

"key_signals": ["触发该分类的关键词1", "关键词2"]

}

询盘内容:

{inquiry_text}

"""

注意:confidence 低于0.7的询盘会被标记为"人工复核",不进入自动化流程。这是防止误判的第一道闸门。

任务④:报价草稿生成

这是整个流程里技术含量最高的环节,也是唯一一个我们用了更强模型的任务。

我们对"报价草稿生成"做过实测对比(基于内部评分,非官方benchmark):

| 模型 | 格式准确率 | 逻辑一致性 | 单次延迟 | 相对成本 | |Deepseek R1 | 高 | 高 | 较慢 | 低 |

| GPT-5.1 | 高 | 高 | 中等 | 中等 |

| Gemini 3.1 Pro | 中高 | 中高 | 快 | 中等 |

实测下来,Deepseek R1 在价格推理和SKU匹配的逻辑一致性上表现最稳,且成本极具竞争力,成为我们的主力选择。

任务⑥:邮件润色

这个任务对"风格一致性"要求最高——每封出去的邮件要符合公司的品牌语气,不能今天正式明天随意。我们用 Claude Sonnet 4.6,它在保持风格指令方面的稳定性体感上明显优于其他选项。

---

关于模型切换的工程实现:文中涉及的模型我们都通过统一API入口调用,这样在不同模型间做A/B切换时不需要改业务代码,只需要改配置文件里的 model_name 参数。

我们用的是 [api.884819.xyz](https://api.884819.xyz),支持上面提到的所有模型,按量计费,没有月租。对于这种多模型混用的场景,统一入口是最省事的起点——你不需要同时维护OpenAI、Anthropic、Deepseek三套SDK和三套密钥管理。

小结: 选模型的核心逻辑是"任务适配",不是"越贵越好"。简单任务用轻量模型,复杂推理用强模型,风格输出用擅长指令遵循的模型。三角权衡:速度/质量/成本,没有全赢的选择。

---

第四章:成本控制——钱花在哪,怎么省

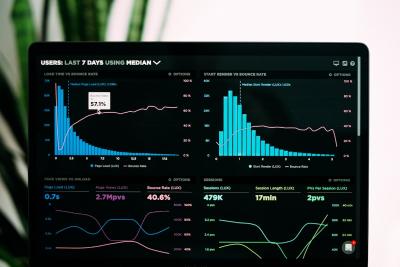

先看改造前后的成本对比。

改造前(人工成本折算):- 业务员平均处理1封复杂询盘:3-4小时

- 按人力成本折算(含机会成本):约80-120元/封

- 每月处理量约400封:月度成本约3.2万-4.8万元

- 每封询盘总token消耗(6个任务合计):约8,000-12,000 tokens

- 按当前价格折算:约0.3-0.8元/封

- 每月400封:月度API成本约120-320元

三个具体的省钱手段

手段一:System Prompt 模板化每次调用都重新写一遍"你是一个外贸助手,你需要……"是最大的token浪费。我们把所有System Prompt固化成模板,变量只有 {inquiry_text} 和 {product_context} 这类占位符。

System Prompt平均从800 tokens压缩到200 tokens,对于每天数百次调用,这个数字很可观。

手段二:产品库预处理缓存最初的方案是每次报价都把完整产品库(约5万字)喂给模型。这是灾难性的做法——不仅token消耗巨大,模型在超长上下文里的注意力也会分散。

改造方案:先用向量检索(embedding)从产品库里捞出最相关的3-5个SKU,只把这部分喂给报价模型。产品描述的embedding每周更新一次,不需要实时计算。

这一步把任务④的token消耗降低了约70%。

手段三:批处理 vs 实时的选择逻辑不是所有任务都需要实时响应。我们的策略是:

- 任务①②③:实时执行(业务员等待,需要快速反馈)

- 任务④⑤⑥:允许30秒内完成(业务员去倒杯水的时间)

- 非工作时间的询盘:批处理,凌晨统一跑,早上上班就有结果

小结: 成本控制的本质是"不做无效计算"。产品库预处理缓存一项,就能让每封询盘的成本从潜在的5元降到0.5元以内。

---

第五章:踩过的三个坑,以及可复制的结论

坑①:模型幻觉导致报价数字出错

发生了什么: 早期版本中,报价模型在没有明确价格数据的情况下,会"合理推断"出一个价格。某次一个客户询问冷门配件,模型给出的报价比实际成本低了40%。幸好业务员复核时发现了。 修复方案:1. 报价JSON里增加 data_source 字段,模型必须标注每个价格的来源(产品库命中 / 历史订单 / 模型推断)

2. data_source = "model_inference" 的字段自动标红,强制人工确认

3. 置信度低于0.8的报价项,不允许进入邮件草稿,跳转人工处理队列

# 报价输出结构示例

{

"sku": "ABC-001",

"unit_price": 12.5,

"currency": "USD",

"data_source": "product_db", # 必填字段

"confidence": 0.95,

"moq": 500,

"lead_time_days": 15

}

原则: AI可以生成,但涉及金额的字段,数据来源必须可追溯。

坑②:多语言询盘的边界情况

土耳其语、阿拉伯语、波斯语混合的询盘,翻译质量会显著下降。我们的处理方案是:语言识别步骤如果检测到"非主流语种"(非英/中/西/法/德/日/韩),自动降级为人工翻译队列,不进入自动化流程。

宁可多花一点人工,也不要让低质量翻译污染后续所有步骤。

坑③:业务员不信任AI输出

这是最难解决的问题,因为它不是技术问题。

我们的解法是:不要让AI替代业务员,让AI给业务员打草稿。

所有AI输出都以"草稿"形式呈现,业务员可以一键采纳、局部修改或完全重写。系统会记录每次修改,一个月后我们发现:90%以上的草稿,业务员只改了称谓和个别措辞,主体内容直接采纳。

信任是用结果建立的,不是用培训建立的。

---

可直接参考的最小可行路径

如果你现在想开始,不需要一次性搭完6个模块。

从意图分类开始(任务②):1. 注册 [api.884819.xyz](https://api.884819.xyz),新用户注册即送体验token,国产模型(Deepseek/千问)完全免费

2. 把上面的 INTENT_CLASSIFICATION_PROMPT 模板复制过去

3. 用最近20封真实询盘测试,看分类准确率

4. 如果准确率超过85%,说明这条路走得通,再往前扩展

10行代码,一次API调用,你就能感受到差距在哪。

---

写在最后

这套方案解决的是单个流程的AI化——从一封询盘进来,到一封邮件草稿出去,这个链路我们已经跑稳了。

但当询盘量从每天20封涨到200封,问题的性质完全变了:

- 某个模型接口突然超时,整条流水线怎么降级?

- 错误率从1%涨到3%,人工兜底的成本已经超过收益怎么办?

- 业务员发现AI出错,但说不清是哪个步骤出的问题,怎么排查?

---

本文由8848AI原创,转载请注明出处。关注8848AI,带你从零开始学AI。#AI外贸 #API实战 #任务拆解 #成本控制 #Prompt工程 #8848AI #AI落地 #外贸自动化