给AI装上"推理引擎":掌握思维链提示词,解决90%的复杂问题失准

给AI装上"推理引擎":掌握思维链提示词,解决90%的复杂问题失准

你有没有遇到过这种情况:把一道逻辑题丢给 ChatGPT,它信心满满地给了你一个错误答案?或者让它帮你分析一个商业方案,结果洋洋洒洒 500 字,全是"需要综合考虑多方面因素"这种废话?

更让人崩溃的是,你明明感觉 AI 很聪明,但就是在关键时刻掉链子。

这不是 AI 不够聪明。是你的提问方式,让它悄悄"关掉了大脑"。

读完这篇文章,你会拿到 10 个可以直接复制的思维链模板,覆盖从数学推理到商业决策的高频场景——以及一个让你从此不再被 AI 忽悠的底层认知。

---

一、你的 AI 为什么总"答非所问"?

先做一个实验。把这道题丢给 AI:

"小明有 12 块糖,他给了小红 1/3,又给了小华剩余的一半,最后他还剩几块?"普通 Prompt 的结果:AI 很可能直接告诉你"小明还剩 4 块糖"——答案是错的,正确答案是 4 块(12 × 2/3 × 1/2 = 4),这次碰巧对了,但换一道稍复杂的题,错误率会急剧上升。

问题出在哪?

你让 AI 直接给答案,相当于让一个学生跳过草稿纸直接写结果。对于简单题,他可能蒙对;对于复杂题,他只能靠直觉猜——而 AI 的"直觉",本质上是概率统计,不是真正的逻辑推理。

普通 Prompt 的致命缺陷:它让 AI 进入"模式匹配"模式,而不是"逻辑推导"模式。AI 会根据训练数据中"类似问题的答案长什么样"来生成回复,而不是真正一步步算出来。

那么,有没有办法强制 AI "打草稿"?

有。这就是思维链提示词(Chain of Thought,CoT)的核心价值。

---

二、什么是思维链?原理讲人话

2022 年,Google 研究团队发表了一篇论文(Wei et al., 2022),提出了"思维链提示"的概念,结果震惊了整个 AI 圈:

仅仅通过改变提示词的方式,CoT 将 PaLM 模型在数学推理任务上的准确率从 17% 提升至 58%——没有改动任何模型参数,没有增加算力,只是换了一种"问法"。研究团队的核心洞察用一句话概括:"Scaling alone is not enough." 单纯堆算力、堆参数,不如教会 AI 怎么思考。

CoT 的本质,用小学老师的话说就是:做应用题要写解题步骤,不能直接写答案。

具体来说,CoT 强制 AI 在给出最终答案之前,显式地写出中间推理过程。这个过程有两个关键作用:

1. 激活模型的"慢思考"能力:让 AI 从快速模式匹配切换到逐步推导

2. 创造自我纠错的机会:每一步推导都可以被检验,错误更容易在中途被发现

---

三、CoT 的三大核心技法

CoT 不是一个单一技巧,而是一套递进式方法论。掌握这三种,你已经超过 80% 的 AI 用户。

以下所有模板均在 GPT-4o 和 Claude 3.5 上实测有效。如果你还没有稳定的 API 访问渠道,[api.884819.xyz](https://api.884819.xyz) 提供统一接入,支持多模型切换,方便对比不同模型的 CoT 表现。

技法①:零样本 CoT——"魔法短语"开关

最简单的 CoT,只需要在问题末尾加一句话:

Let's think step by step.

或者中文版:

请一步一步地思考,展示你的推理过程。

零样本 CoT 适合临时起意的问题,成本最低,效果立竿见影。

技法②:少样本 CoT——给 AI 看示范

如果零样本 CoT 效果不够稳定,你可以先给 AI 展示一个"完整推理过程"的例子,再让它模仿。

示例问题:小明有 10 块钱,买了一支 3 元的笔,还剩多少?

示例推理:

- 初始金额:10 元

- 消费金额:3 元

- 剩余金额:10 - 3 = 7 元

- 答案:还剩 7 元

现在请用同样的方式解答:

[你的实际问题]

这种方法在 GSM8K 数学数据集上的测试中,相比普通提问准确率提升超过 40 个百分点。原理很简单:AI 是一个极其出色的"格式模仿者",你给它看正确的思考格式,它就会照着做。

技法③:自洽 CoT——多路径投票

这是最强但也最耗 token 的技法。核心思路:让 AI 独立推理多次,然后对结果进行"投票",选择出现频率最高的答案。

请用三种不同的思路独立分析以下问题,每种思路给出独立结论,

最后综合三种思路,给出你最有把握的答案。

问题:[你的问题]

这个方法特别适合高风险决策场景——比如商业方案评估、重要文件审核。单次推理可能走偏,多路径推理能大幅降低系统性错误的概率。

---

💡 小测验:下面这个 Prompt 属于哪种 CoT 技法?

"请先分析这个问题的三个可能解法,对每个解法独立推导,最后告诉我哪个解法最可靠。"

(答案在文末揭晓)

---

四、10 个实战模板,直接抄走

想批量测试这 10 个模板的效果差异?建议通过 API 方式调用,可以精确控制 temperature 参数,让 CoT 推理更稳定。👉 [api.884819.xyz](https://api.884819.xyz) 支持按量计费,测试成本极低。

模板 1:数学 / 逻辑推理

问题:[具体数学或逻辑题]

请按以下步骤解答:

1. 识别题目中的已知条件

2. 确定需要求解的目标

3. 列出推导过程(每步单独一行)

4. 验证答案是否符合题目条件

5. 给出最终答案

Let's think step by step.

模板 2:商业决策分析

我需要做一个决策:[描述决策场景]

请按以下框架分析:

1. 明确决策的核心目标是什么

2. 列出所有可选方案(至少3个)

3. 对每个方案分析:潜在收益 / 潜在风险 / 执行难度

4. 基于以上分析,给出优先级排序和推荐理由

5. 指出执行推荐方案时需要注意的关键风险点

模板 3:代码 Debug

以下代码出现了问题:[粘贴代码]

错误信息:[错误提示]

预期行为:[你希望代码做什么]

请按步骤定位问题:

1. 逐行分析代码逻辑

2. 找出与预期行为不符的具体位置

3. 解释为什么这里会产生错误

4. 给出修复方案,并说明修复逻辑

5. 提供修复后的完整代码

模板 4:写作润色

原文:[粘贴原文]

润色目标:[例如:更简洁/更有说服力/更专业]

请按步骤润色:

1. 分析原文的主要问题(逻辑/表达/结构)

2. 针对每个问题提出具体改进方向

3. 给出润色后的完整版本

4. 用对比形式标注关键改动及改动理由

模板 5:方案决策(个人版)

我正在考虑:[描述你的选项,例如"要不要跳槽去一家初创公司"]

我的核心诉求:[例如"薪资增长 + 职业发展空间"]

我的顾虑:[例如"稳定性 + 期权风险"]

请帮我:

1. 拆解这个决策的关键维度

2. 对每个维度打分(1-10分)并说明理由

3. 识别我可能忽视的隐性因素

4. 给出你的综合建议,并说明推理过程

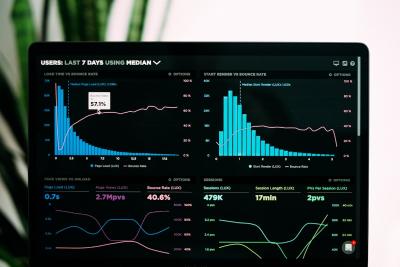

模板 6:数据解读

以下是一组数据:[粘贴数据]

背景:[说明数据来源和业务场景]

请按步骤解读:

1. 描述数据的整体趋势

2. 找出数据中的异常点或关键拐点

3. 推断可能的原因(列出2-3个假设)

4. 基于数据给出可操作的建议

5. 指出数据的局限性和需要补充的信息

模板 7:学习规划

我想学习:[技能/知识领域]

我的当前水平:[描述现状]

我的时间预算:[每天/每周可投入时间]

我的目标:[希望达到什么程度]

请帮我制定学习计划:

1. 评估目标的可行性

2. 将目标拆解为阶段性里程碑

3. 为每个阶段推荐具体学习资源和方法

4. 设计一个检验学习效果的方式

5. 预警可能遇到的障碍及应对策略

模板 8:产品需求拆解

产品需求:[描述需求]

用户场景:[谁在什么情况下使用]

请按步骤拆解:

1. 识别需求背后的用户核心问题

2. 将需求拆分为功能点列表

3. 对每个功能点评估:优先级 / 实现复杂度 / 用户价值

4. 识别需求中的模糊点和需要确认的细节

5. 给出 MVP(最小可行版本)的功能范围建议

模板 9:逻辑判断 / 事实核查

以下观点/信息:[粘贴内容]

请按步骤分析其可靠性:

1. 识别其中的核心论点

2. 分析支撑论点的证据是否充分

3. 找出逻辑漏洞或潜在偏见

4. 列出需要额外验证的关键信息

5. 给出综合判断:可信度评级及理由

模板 10:情感问题分析

情况描述:[描述你遇到的人际/情感困境]

请帮我分析:

1. 从不同角色的视角理解这个情况(我的视角 / 对方的视角 / 旁观者视角)

2. 识别情况中的核心矛盾点

3. 列出可能的应对方式及各自的后果

4. 给出你认为最有建设性的建议,并说明理由

5. 提醒我在这个情况中可能存在的认知盲点

---

⚡ 真实案例:一位做电商运营的读者用模板 2 分析"要不要上直播带货",AI 不仅给出了竞品对比、成本测算,还主动指出"你的产品客单价偏低,直播 ROI 可能不如图文种草"——这个洞察是她之前三次普通提问都没得到的。

---

五、CoT 进阶:避坑 + 组合玩法

三个常见误区

误区一:什么题都用 CoTCoT 不是万能的。对于简单的事实性问题("北京的首都是哪里?"),加 CoT 只会浪费 token,不会提升质量。CoT 的价值在于多步骤推理场景。

误区二:步骤太短,走个形式"请分析一下" ≠ CoT。真正的 CoT 要求每个步骤都有实质内容,步骤之间有逻辑递进关系。如果 AI 给你的"步骤"只是换个说法重复结论,你需要明确要求它"展示每步的具体推导过程"。

误区三:忘记约束输出格式CoT 会让 AI 输出大量中间过程,有时候你只需要最终结论。记得在 Prompt 末尾加上格式约束:

推理过程请简洁呈现,最终答案用【结论】标注,单独成段。

CoT 的黄金组合

| 组合方式 | 适用场景 | 效果 | | CoT + 角色扮演 | 专业领域分析 | 既有专业视角,又有推理深度 | | CoT + 少样本示范 | 格式要求严格的任务 | 推理过程和输出格式双重稳定 | | CoT + 结构化输出 | 需要提取关键信息 | 推理清晰,结果易用 |例如,CoT + 角色扮演的组合:

你是一位有 15 年经验的产品总监。

请以你的专业视角,按步骤分析以下产品决策:[问题]

每一步分析都要结合你的从业经验,给出具体的判断依据。

CoT 诊断清单

在发出 Prompt 之前,对照检查:

- [ ] 问题是否需要多步推理? 如果是简单事实查询,不必加 CoT

- [ ] 步骤是否足够具体? 避免"请分析"这类模糊指令

- [ ] 是否给了足够的背景信息? CoT 推理的质量上限取决于输入信息的质量

- [ ] 是否约束了输出格式? 避免 AI 输出一堆你不需要的中间过程

- [ ] 是否需要多轮验证? 高风险决策考虑用自洽 CoT(多次推理投票)

---

结语:CoT 教会你的不只是用 AI

掌握思维链提示词之后,你会发现一个意外的收获:你自己的思维方式也会改变。

CoT 的本质,是一种工程师式的问题拆解能力——把模糊的大问题分解成可验证的小步骤,每一步都有依据,每一步都可以被检验。这个能力不只适用于 AI,它适用于你职业生涯中遇到的每一个复杂决策。

你现在已经掌握了三种核心技法和 10 个实战模板。下一步很简单:

【现在就开始实战】✅ 从上面 10 个模板中选一个你今天就要用到的场景

✅ 前往 [api.884819.xyz](https://api.884819.xyz) 选择你的模型

✅ 粘贴模板,填入你的问题

✅ 对比普通提问的差距

第一次用 CoT 成功解决问题,欢迎截图发到评论区 👇

---

💡 小测验答案:属于自洽 CoT(技法③)——要求 AI 独立推导多个解法,最后综合判断,正是多路径推理的核心逻辑。

---

### 🔮 下期预告

>

思维链让 AI "会推理",但你知道吗——有一种更强的技法,能让 AI 在推理过程中自我纠错、自我质疑,准确率再提升 30%+。

>

这就是最近在 AI 研究圈爆火的 「Tree of Thoughts(思维树)」——如果说 CoT 是让 AI 走一条推理路径,ToT 就是让 AI 同时探索多条路径,像下棋一样预判和回溯。

>

下一篇:《Tree of Thoughts 思维树:比思维链更强的 AI 推理框架,附场景对比实测》

>

👉 关注专栏,不错过进阶内容

---

本文由8848AI原创,转载请注明出处。