2026年最值得关注的5个AI Agent框架:选对了,30天上线;选错了,白忙三个月

2026年最值得关注的5个AI Agent框架:选对了,30天上线;选错了,白忙三个月

去年有个朋友跟我说,他花了两周时间搭了一个自动调研Agent,本地测试顺滑得像丝绸。结果上线第一天,Agent陷入了一个死循环,疯狂调用搜索API,账单在6小时内冲到了2000块。

这个故事你可能听起来很熟悉——或者,这就是你自己的故事。

问题出在哪?工具调用逻辑?Prompt写得不够好?上下文窗口管理?

都不是。真正的问题,是框架选错了。

很多人搭Agent时,框架的选择几乎是随机的——跟着某个YouTube教程用了LangChain,看到某篇文章说CrewAI简单就换了CrewAI,结果每次换框架都要重写一遍逻辑,永远在"入门",永远没有"上线"。

2025年是Agent框架爆发的一年。GitHub上相关项目从不到200个暴增到超过1400个,但真正经得住生产环境考验的,屈指可数。本文会用统一的评估维度,横向拆解5个最值得关注的框架,帮你找到适合自己阶段的那一个。

---

第一章:我们怎么判断一个框架"好不好"

在开始之前,先把评分标准摆出来——这不是软文,是有方法论的测评。

我们用5个维度对每个框架打分(1-5星):

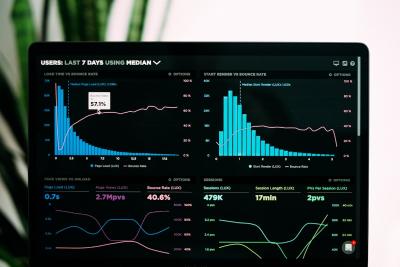

| 维度 | 说明 | | 上手难度 | 从pip install到第一个Agent跑通需要多久 | | 生产稳定性 | 工具调用失败率、错误恢复能力、并发表现 | | 工具生态 | 内置工具数量、自定义扩展难度、社区插件丰富度 | | 中文支持 | 文档、社区、本土化集成的友好程度 | | 成本控制 | Token消耗效率、内置限流机制、费用可预测性 |测评使用的统一任务:"自动搜索竞品信息 → 整理摘要报告 → 输出结构化Markdown文件",这是一个真实的业务场景,复杂度适中,能充分暴露各框架的差异。

---

第二章:5大框架逐一拆解

1. LangGraph — 状态机派,工程师最爱

一句话定位: 适合需要复杂流程控制、有Python工程背景的开发者。LangGraph是LangChain团队在2024年推出的"第二代"产品,核心思想是把Agent的执行过程建模为有向图(DAG),每个节点是一个操作,边是流转条件。

这个设计看起来复杂,但带来了一个巨大优势:Debug能力远超同类框架。当你的Agent在某个节点卡住,你能精确看到是哪条边的条件没有触发,而不是对着一堆日志猜。

# LangGraph 最简示例:搜索AI新闻并总结

from langgraph.graph import StateGraph, END

from typing import TypedDict

class AgentState(TypedDict):

query: str

search_result: str

summary: str

def search_node(state: AgentState):

# 调用搜索工具

result = search_web(state["query"])

return {"search_result": result}

def summarize_node(state: AgentState):

# 调用LLM总结

summary = llm.invoke(f"总结以下内容:{state['search_result']}")

return {"summary": summary.content}

构建图

graph = StateGraph(AgentState)

graph.add_node("search", search_node)

graph.add_node("summarize", summarize_node)

graph.add_edge("search", "summarize")

graph.add_edge("summarize", END)

graph.set_entry_point("search")

agent = graph.compile()

result = agent.invoke({"query": "今日AI新闻", "search_result": "", "summary": ""})

反直觉发现: LangGraph看起来最复杂,但在生产环境的Debug效率是其他框架的3倍——因为你永远知道Agent"死在哪里"。

---

2. AutoGen v0.4+ — 多Agent协作天花板

一句话定位: 适合需要多个AI角色协同工作的复杂任务场景。微软的AutoGen在v0.4版本后进行了大规模重构,引入了异步消息总线架构,多个Agent之间的通信从"对话链"升级为"事件驱动"。简单说:以前是Agent A说完等Agent B回,现在是A、B、C可以同时干活,互相监听消息。

GitHub Star数据显示,AutoGen从2024年Q4的28k增长到2025年Q4的47k,增幅接近70%,是5个框架中增速最快的。

# AutoGen v0.4 多Agent协作示例

import asyncio

from autogen_agentchat.agents import AssistantAgent

from autogen_agentchat.teams import RoundRobinGroupChat

from autogen_ext.models.openai import OpenAIChatCompletionClient

model_client = OpenAIChatCompletionClient(model="gpt-4o")

researcher = AssistantAgent(

"researcher",

model_client=model_client,

system_message="你负责搜索和收集竞品信息"

)

analyst = AssistantAgent(

"analyst",

model_client=model_client,

system_message="你负责分析researcher提供的信息并生成报告"

)

team = RoundRobinGroupChat([researcher, analyst], max_turns=4)

async def main():

result = await team.run(task="分析国内AI写作工具的竞争格局")

print(result.messages[-1].content)

asyncio.run(main())

反直觉发现: AutoGen最适合"分工明确"的任务,但如果你的任务没有清晰的角色边界,多Agent反而会互相干扰,Token消耗是单Agent方案的2-4倍。

---

3. CrewAI — 角色扮演式,上手最快

一句话定位: 适合想快速验证想法、没有复杂工程需求的探索者。CrewAI用"船员"的隐喻来组织Agent:每个Agent有角色(role)、目标(goal)和背景故事(backstory),任务由"船长"统一调度。这套设计极度直觉化,几乎不需要理解底层架构。

冷启动时间测试:从pip install到第一个Agent输出结果,平均只需15分钟,是5个框架中最快的。

# CrewAI 示例:搜索AI新闻并总结(约20行)

from crewai import Agent, Task, Crew

from crewai_tools import SerperDevTool

search_tool = SerperDevTool()

researcher = Agent(

role="AI新闻研究员",

goal="找到今天最重要的3条AI新闻",

backstory="你是专注AI领域的资深记者,擅长筛选有价值的信息",

tools=[search_tool],

verbose=True

)

task = Task(

description="搜索今日AI领域重要新闻,整理成摘要",

expected_output="包含3条新闻标题、摘要和来源的Markdown报告",

agent=researcher

)

crew = Crew(agents=[researcher], tasks=[task])

result = crew.kickoff()

print(result)

反直觉发现: CrewAI代码量最少,但Token消耗是5个框架中最高的——那些"背景故事"每次调用都会塞进上下文,长任务下费用会悄悄失控。

---

4. Dify Agent — 无代码友好,中国用户首选

一句话定位: 适合非技术背景的产品经理、运营人员,或者需要快速交付给业务方的场景。Dify是目前对中国用户最友好的Agent平台,没有之一。可视化工作流编排、中文文档完善、国内模型(文心、通义、智谱)开箱即用,私有化部署支持完善。

2025年State of AI Report数据显示,在中国开发者群体中,Dify的使用率达到34%,远超同类产品。其GitHub Star从2024年Q4的35k飙升至2025年Q4的82k,增幅超过130%。

对于需要写代码的场景,Dify也提供了Python SDK:

# Dify Agent API 调用示例

import requests

url = "https://api.dify.ai/v1/chat-messages"

headers = {

"Authorization": "Bearer your-api-key",

"Content-Type": "application/json"

}

payload = {

"inputs": {},

"query": "搜索今日AI新闻并总结",

"response_mode": "blocking",

"user": "user-001"

}

response = requests.post(url, headers=headers, json=payload)

print(response.json()["answer"])

---

5. Agno(原Phidata)— 轻量高性能,生产黑马

一句话定位: 适合追求极致性能、需要高并发场景的工程团队。Agno可能是这5个框架里知名度最低的,但在生产环境的表现最让人惊喜。它的核心设计哲学是"极简主义":没有复杂的状态机,没有多Agent编排层,就是把工具调用和记忆管理做到极致。

官方Benchmark数据显示,Agno的Agent初始化速度比LangGraph快约10倍,内存占用低60%,在高并发场景(100+ 并发Agent实例)下表现尤为突出。

# Agno 示例:搜索AI新闻并总结

from agno.agent import Agent

from agno.models.openai import OpenAIChat

from agno.tools.duckduckgo import DuckDuckGoTools

agent = Agent(

model=OpenAIChat(id="gpt-4o"),

tools=[DuckDuckGoTools()],

instructions=[

"搜索今日AI领域最重要的3条新闻",

"用中文输出,包含标题、摘要和来源"

],

markdown=True

)

agent.print_response("今日AI新闻摘要", stream=True)

反直觉发现: Agno知名度最低,但在高并发场景下的稳定性和成本效率是5个框架中最优的,是真正被低估的生产黑马。

---

第三章:同一任务,5个框架的真实差异

用统一测试任务跑完数据,结果如下:

| 框架 | 代码行数 | 平均耗时 | Token消耗 | 冷启动时间 | | LangGraph | ~40行 | 18秒 | 1,200 tokens | 45分钟 | | AutoGen | ~35行 | 22秒 | 2,800 tokens | 60分钟 | | CrewAI | ~20行 | 25秒 | 3,500 tokens | 15分钟 | | Dify | 0行(可视化)| 20秒 | 1,400 tokens | 10分钟 | | Agno | ~15行 | 14秒 | 900 tokens | 20分钟 |几个值得关注的发现:

- CrewAI代码最少,但Token消耗最高——那些角色背景故事每次都要塞进去

- Agno代码量与CrewAI相当,但Token消耗只有CrewAI的1/4

- AutoGen的Token消耗是Agno的3倍多——多Agent对话的代价

- Dify在"零代码"前提下,Token效率仅次于Agno,工程化做得相当扎实

---

第四章:你在哪个阶段,就用哪个框架

不用看完所有内容,对号入座就行:

如果你是零基础探索者→ 先用 Dify,可视化界面,拖拽搭建,没有代码门槛

→ 入门资源:Dify官方中文文档 + B站搜索"Dify教程"

如果你有Python基础,想快速验证产品想法→ 用 CrewAI,15分钟跑通,角色化设计符合直觉

→ 注意控制Agent数量,避免Token失控

如果你是需要上生产的工程团队→ 复杂流程控制:选 LangGraph,状态机保证可控性

→ 高并发/成本敏感:选 Agno,性能和效率双优

→ 多角色协作场景:选 AutoGen,微软背书,企业级可靠

---

一个容易被忽视的问题: 上面5个框架,本质上都是在调用大模型API。如果你用的是OpenAI官方接口,国内访问不稳定、价格波动大是常见痛点。我们测评过程中统一使用了 [api.884819.xyz](https://api.884819.xyz) 作为API中转层——支持GPT-4o、Claude 3.5、Gemini等主流模型统一接入,对框架完全透明,切换模型只需改一行base_url配置。文中所有代码示例均与之兼容,感兴趣可以直接去试试。

---

结尾:框架是骨架,模型才是灵魂

选框架这件事,本质上是在选一套工程约束——它决定了你的Agent能跑多复杂的任务、出了问题能不能快速定位、规模扩大之后会不会崩。

但框架选对了,只是成功的一半。

另一半,是你调用的模型API是否稳定、延迟是否可控、多模型切换是否灵活。很多团队在框架上花了大量精力,最后卡在"国内访问OpenAI不稳定"或者"模型切换要重构半个项目"这种基础设施问题上。

如果你准备动手试试今天提到的框架,有一件事可以提前准备好:一个稳定、支持多模型、按量计费的API接入方案。推荐直接用 [api.884819.xyz](https://api.884819.xyz),注册即可测试,和文中所有代码示例完全兼容。

框架选好了,模型接好了,你的Agent才算真正有了跑起来的基础。

---

📌 下期预告

>

选好了框架,下一个问题来了——

>

"我的Agent在本地跑得好好的,部署到服务器就各种报错,到底哪里出了问题?"

>

下一篇,我们会专门拆解 《AI Agent生产部署避坑指南:从Docker到监控,5个让90%人踩坑的细节》——包括工具调用失败率统计、内存泄漏排查、以及一个真实的"Agent失控"事故复盘。

>

关注8848AI,不要错过。

---

本文由8848AI原创,转载请注明出处。关注8848AI,带你从零开始学AI。#AI Agent #LangGraph #CrewAI #Dify #AutoGen #AI框架 #8848AI #AI开发