DeepSeek V3.2 vs Claude Sonnet 4.6:我用20个真实任务测完,差点退订了付费订阅

DeepSeek V3.2 vs Claude Sonnet 4.6:我用20个真实任务测完,差点退订了付费订阅

我每个月花 ¥140 订阅 Claude,上周差点退订了。

不是因为 Claude 变差了,而是因为我做了一件本不该做的事——把 DeepSeek V3.2 的免费额度拿来跑了同一批工作任务,然后把输出结果并排放在一起。

那一刻我盯着屏幕沉默了大概30秒。

某些任务上,两边的差距小到让我怀疑自己是不是搞错了版本。更让我不安的是,有几个任务 DeepSeek 给出的答案,质量明显在 Claude 之上。

但我最终没退订。原因在第四章。

---

测评框架:我怎么保证这次对比是公平的

先说清楚规则,再看结果。

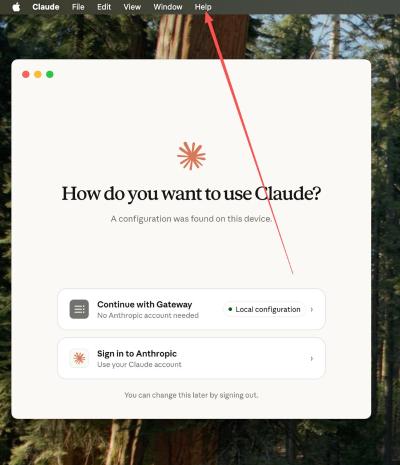

测试对象

- DeepSeek V3.2:官网免费额度 + API 调用,模型版本

deepseek-v3 - Claude Sonnet 4.6:Anthropic 官方 API,模型版本

claude-sonnet-4-6(注意不是 Opus,Opus 贵三倍,那是另一个级别的对比)

版本确认很重要。很多测评踩坑就是因为用了不同时期的快照版本,导致结果根本没有可比性。

6大测试维度 × 20个任务

| 维度 | 任务数 | 说明 | | 代码生成 | 4 | 真实工作代码,含爬虫、数据处理、API 封装 | | 长文写作 | 3 | PRD 文档、方案报告、行业分析 | | 逻辑推理 | 4 | 数学应用题、因果分析、反事实推断 | | 中文理解 | 3 | 古文释义、歧义句分析、方言语境理解 | | 多轮对话 | 3 | 模拟需求澄清、角色扮演、上下文追踪 | | 创意发散 | 3 | 产品命名、广告文案、故事开头 |这20个任务全部来自我过去三个月的真实工作记录,不是从网上找的"刷榜题"。刷榜题的问题在于,模型可能在训练集里见过,测的是记忆而不是能力。

评分标准

每个任务由我本人盲评(不看模型标签)打分,满分10分,评分维度包括:准确性、完整性、可用性(能否直接用于工作)、表达质量。

⚠️ 重要说明:本次测评为个人真实体验,无任何赞助。所有 Prompt 和输出均保留原始记录,部分因篇幅限制做了摘录。

顺带说一句,这次测评两个模型我都是通过同一个 API 入口调用的——[api.884819.xyz](https://api.884819.xyz),支持 DeepSeek、Claude、GPT 等主流模型,一个 Key 全搞定,对想批量测试的开发者特别友好。不用分别申请账号、管理多套密钥,切换模型只需要改一行代码。

---

逐项对决:20个任务的胜负榜

总览:先看格局

| 维度 | DeepSeek 胜 | 平局 | Claude 胜 | | 代码生成 | 3 | 1 | 0 | | 长文写作 | 1 | 1 | 1 | | 逻辑推理 | 2 | 1 | 1 | | 中文理解 | 2 | 1 | 0 | | 多轮对话 | 0 | 1 | 2 | | 创意发散 | 1 | 2 | 0 | | 合计 | 9 | 7 | 4 |DeepSeek 9胜4负7平。比我预期高出不少。

下面逐维度拆解几个典型案例。

---

🔵 代码生成:DeepSeek 的主场

典型任务:优化一段 Python 爬虫原始代码是我一个月前写的,用 requests + BeautifulSoup 抓取某电商平台商品数据,问题是频繁被反爬,需要加入随机延迟、UA 轮换和异常重试逻辑。

帮我优化以下 Python 爬虫代码,要求:

1. 加入随机 User-Agent 轮换

2. 请求失败自动重试(最多3次,指数退避)

3. 随机延迟 1-3 秒

4. 保持原有的数据解析逻辑不变

[原始代码 约80行]

除了完成三项要求,它额外加入了 fake_useragent 库的降级处理(当库不可用时 fallback 到内置列表),并在注释里解释了为什么用指数退避而不是固定延迟——这是我没要求的,但确实是工程上更合理的做法。

代码同样正确,但注释风格更偏"教学向",解释多于实现。对于直接要用的工程师来说,这反而有点啰嗦。

点评: DeepSeek 赢在"工程感"——它理解你要的是能跑的代码,不是代码课。---

🔴 意外反转:逻辑推理里 DeepSeek 赢了大家以为 Claude 稳赢的题

这是本次测评最让我意外的一个结果。

任务: 一道经典的贝叶斯推断应用题(医疗诊断场景,给定患病率、检测灵敏度和特异度,求阳性结果下真实患病的概率)。很多人默认 Claude 在推理上更严谨,但这次 DeepSeek 不仅给出了正确答案,还主动指出了题目表述中一个容易引起歧义的地方,并分别给出了两种解读下的计算结果。

Claude 给出了正确答案,但没有注意到歧义。

这个细节让我重新审视了一个先入为主的判断:逻辑严谨不等于表达严谨,DeepSeek 在某些推理任务上的细心程度超出预期。

---

🟡 中文理解:意料之中的 DeepSeek 优势

典型任务:古文语境理解Prompt 是一段《世说新语》的片段,要求分析人物关系和潜台词,并用现代职场语言重新表述其中的"话外音"。

DeepSeek 的输出在文化语境的把握上明显更准确,重新表述的职场版本也更接地气,读起来像是一个真正懂中文语感的人写的。

Claude 的输出在字面意思上没有问题,但"现代职场版"的转化略显生硬,有翻译腔。

这个结果在我预期之内——DeepSeek 的中文训练数据质量和覆盖面在这个价位段确实有优势。

---

🔴 多轮对话:Claude 的护城河

踩坑案例:DeepSeek 在多轮需求澄清中跑偏这是 DeepSeek 本次测评里最明显的失误。

任务背景:模拟一个产品经理向 AI 澄清需求的场景,共7轮对话,中途我故意改变了一个核心假设(从 ToC 产品改为 ToB 产品)。

DeepSeek 在第5轮之后出现了明显的"上下文漂移"——它开始混用前后两个阶段的设定,给出的建议里同时出现了 ToC 和 ToB 的逻辑,自相矛盾。

Claude 全程保持了对话的一致性,在我改变假设的那一轮,它还主动确认:"您刚才提到转向 ToB 场景,这意味着之前讨论的用户增长策略需要重新评估,我先暂停那部分建议,等您确认新方向后继续。"

这种"主动暂停确认"的行为,是 Claude 在长上下文对话中的核心优势。

---

成本对比:这才是真正的杀手锏

| 项目 | DeepSeek V3.2 | Claude Sonnet 4.6 | | 免费额度 | 每日限额(官网) | 无免费 API | | API 输入价格 | ¥1/百万 Token | ~¥21/百万 Token | | API 输出价格 | ¥2/百万 Token | ~¥63/百万 Token | | 平均首字延迟 | ~800ms | ~1200ms | | 上下文窗口 | 128K | 200K |价格差距是21倍。这个数字放在这里,不需要我多说什么。

---

DeepSeek 赢不了的那 20%——说实话的部分

好,现在说让我保留 Claude 订阅的原因。

1. 超长上下文的连贯性

200K vs 128K 的窗口差距,在日常任务里感受不明显。但当你需要处理一份8万字的合同文件,或者让模型"记住"一个复杂项目的完整背景时,Claude 的表现会更稳定。

DeepSeek 在超长输入的后半段有时会出现"遗忘"现象——不是完全忘记,而是对早期内容的引用变得模糊,细节精度下降。

2. 英文学术写作的语感

如果你需要写 SCI 论文、英文商业报告,或者需要那种"native speaker 感"的英文输出,Claude 目前仍然领先。

DeepSeek 的英文输出正确,但在语感上有时会有一种难以言说的"非母语感",在学术写作的细节处理上(如被动语态的使用、学科术语的选择)不如 Claude 自然。

3. 高度模糊需求的理解力

当你的 Prompt 写得很烂的时候,Claude 更能"猜到你想要什么"。

这听起来像是在夸 Claude 的读心术,但本质上是它在模糊输入下的鲁棒性更强。DeepSeek 在 Prompt 不清晰时,更倾向于按字面意思执行,而不是主动补全你的意图。

这个特性是双刃剑:对于想要精确控制输出的用户,DeepSeek 的"按字面执行"反而是优点。

---

结论:给不同读者的选择路径

不说废话,直接给决策树。

你的主要使用场景是什么?

│

├── 代码开发 / 数据处理 / 中文内容生产

│ └── 预算有限?

│ ├── 是 → DeepSeek V3.2,免费额度够用

│ └── 否 → DeepSeek API,成本是 Claude 的 1/20

│

├── 长文档分析 / 多轮复杂对话 / 英文学术写作

│ └── → Claude Sonnet 4.6,该花就花

│

└── 混合场景(大多数人)

└── → 两个都用,按任务类型路由

DeepSeek 做初稿和代码

Claude 做精修和复杂对话

真正的最优解不是"选哪个",而是"怎么组合"。用 DeepSeek 处理高频、批量、对成本敏感的任务;用 Claude 处理需要高精度、长上下文、复杂推理的任务。

如果你想自己复现这20个测试,最省事的方法是用统一 API 平台,不用分别申请账号。在 [api.884819.xyz](https://api.884819.xyz) 注册后,两个模型都能直接调用,切换只需改一个参数:

import openai

client = openai.OpenAI(

api_key="your-key",

base_url="https://api.884819.xyz/v1"

)

prompt = "帮我优化以下 Python 爬虫代码..."

一行切换模型,对比输出

for model in ["deepseek-v3", "claude-sonnet-4-6"]:

response = client.chat.completions.create(

model=model,

messages=[{"role": "user", "content": prompt}]

)

print(f"\n[{model}]")

print(response.choices[0].message.content)

上面这段代码直接可以跑,base_url 换成 api.884819.xyz/v1 就行,新用户有免费额度可以先试试手,把这20个任务自己跑一遍,比看我的评测更有说服力。

---

下期预告

>

这次测评结束后,有读者问我一个我没答上来的问题:

"如果我只有 ¥50 的 API 预算,一个月怎么用才能最大化产出?"

>

我正在测试一套「穷人版 AI 工作流」——用 DeepSeek 做初稿、Claude 做精修、GPT-4o 做最终校验,三模型接力,成本控制在单篇 ¥0.3 以内。初步结果比我预期的好很多,有几个细节反而让我重新思考"贵的模型到底贵在哪里"。

>

下周五发,建议先关注,别到时候找不到。

---

本文由8848AI原创,转载请注明出处。关注8848AI,带你从零开始学AI。#DeepSeek #Claude #AI测评 #大模型对比 #AI工具 #8848AI #AI工作流 #人工智能