DeepSeek V3.2 免费还这么能打?我拿它和 Claude Sonnet 4.6 对比了 20 个真实任务

DeepSeek V3.2 免费还这么能打?我拿它和 Claude Sonnet 4.6 对比了 20 个真实任务

我本来只是随手测了一下,结果把自己测沉默了。

DeepSeek V3.2 在我设计的 20 个任务里,赢了 Claude Sonnet 4.6 整整 12 局。

这句话我说出来自己都觉得有点离谱——毕竟一个免费,一个每月要花不少钱。但数据就是数据,我没办法假装没看到。

当然,结论没那么简单。那 8 局 Claude 赢的,赢得也很彻底。问题不是"谁更强",而是"你的场景适合谁"。这篇文章就是要把这个问题说清楚。

---

为什么要认真做这场对比

DeepSeek V3.2 是在几乎没有任何宣传的情况下悄悄上线的。没有发布会,没有官方 benchmark 轰炸,就这么出现了。但社区里的反馈让我起了好奇心——有人说代码能力大幅提升,有人说中文写作更自然了,也有人说"感觉和上个版本差不多"。

众说纷纭,不如自己测。

Claude Sonnet 4.6 是我选的对照组,理由很简单:它是当前公认的综合能力天花板之一,也是我日常付费使用的主力模型。拿它做参照,结论才有参考价值。

测试方法论说明:- 20 个任务按 5 大维度分类,每维度 4 题

- 采用盲测制:先记录回答,再评分,避免"看到模型名就有预设"

- 每题满分 10 分,评分维度包括准确性、完整性、表达质量

- 测试环境统一:通过 API 调用,排除网页端记忆和系统 Prompt 干扰

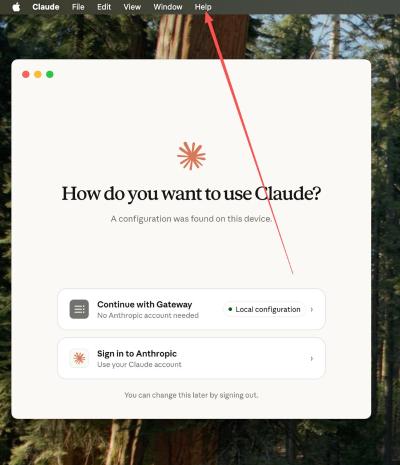

⚠️ 重要说明: 本文所有测试均通过 api.884819.xyz 统一接口完成,同一 Key 同时调用两个模型,保证变量一致。响应速度数据也在同一网络环境下采集。

---

20 个任务,5 大维度全面交锋

维度一:代码编写(4 题)

这是我最期待的维度,也是结果最出乎意料的地方。

测试题目包括:1. 写一个带反爬处理的爬虫脚本

2. Debug 一段含 3 个隐藏 Bug 的 Python 代码

3. 用 SQL 写一个复杂多表查询

4. 解释一段复杂的正则表达式

我原本以为 Claude 会在这里拉开差距。结果是:DeepSeek 3 胜 1 负。

最戏剧性的是 Debug 题。我故意在代码里藏了 3 个 Bug:一个类型错误、一个边界条件漏洞、一个逻辑上的竞态条件。Claude 找出了 2 个,DeepSeek 找出了全部 3 个,而且给出的修复方案更简洁。

Claude 唯一赢的是正则表达式解释题——它的解释更有层次感,把每个字符组的语义讲得非常清晰,DeepSeek 的版本稍显罗列,缺乏叙事逻辑。

代码维度小计:DeepSeek 7.8 / Claude 7.2---

维度二:中文写作(4 题)

测试题目包括:5. 写一封委婉拒绝甲方的邮件

6. 将学术摘要改写成小红书风格

7. 给一篇烂大街的简历写一个亮眼开头

8. 写一段带情绪的产品发布文案

这一组我预判 DeepSeek 会赢——毕竟中文是它的"母语"。但结果是 2:2 平局,而且输赢的方向让我意外。

DeepSeek 在"委婉拒绝邮件"和"简历开头"上完胜。它写的拒绝邮件,那种"我很欣赏你们的项目,但……"的分寸感拿捏得极准,读完不会让甲方觉得受到冒犯,又把意思说清楚了。

但在"小红书改写"上,Claude 的版本更懂网感。它不只是把句子变短、加 emoji,而是真的改变了信息的呈现逻辑——把"结论前置"的网络阅读习惯融进去了。DeepSeek 的版本像是"学生作文版小红书",格式对了,灵魂差点。

中文写作小计:DeepSeek 7.5 / Claude 7.5(平局)---

维度三:逻辑推理(4 题)

测试题目包括:9. 说谎者问题变体(三人版)

10. 分析一个商业决策中的谬误

11. 给出一个论点的反驳角度

12. 推理题:从 5 个线索找凶手

这是 Claude 最强的主场,结果也确实如此:Claude 3 胜 1 负。

说谎者问题上,DeepSeek 给出了正确答案,但推理过程有一步跳跃,如果不是已经知道答案,那个跳跃很难被接受。Claude 的推理链条每一步都有显式依据,像在看一个人真正在"想",而不是"猜"。

两个模型都翻车的是第 11 题(反驳角度)。我给的论点是"996 工作制能提升企业竞争力",两个模型都给出了正确的反驳方向,但都没有触碰到最核心的反驳:这个论点本身混淆了"短期产出"和"长期竞争力"的概念。算是这次测试的一个彩蛋发现——有些思维盲区是共享的。

逻辑推理小计:DeepSeek 6.8 / Claude 8.2---

维度四:数据分析(4 题)

测试题目包括:13. 解读一份销售数据表格(粘贴 CSV)

14. 设计 A/B 测试方案

15. 解释一个反常识的统计结论(辛普森悖论)

16. 给出数据可视化的图表选择建议

DeepSeek 2 胜,Claude 2 胜,平局。DeepSeek 在 CSV 解读上给出了更多主动洞察——它不只是"读"数据,还主动指出了两个我没问到的异常点。Claude 的版本更规范,但稍显"被动"。

辛普森悖论的解释上,Claude 完胜。它用了一个非常好的类比(医院治愈率的例子),把这个反直觉的统计现象讲得连不懂统计的人都能明白。DeepSeek 的版本正确但干燥。

数据分析小计:DeepSeek 7.6 / Claude 7.8---

维度五:创意任务(4 题)

测试题目包括:17. 为一款 AI 工具想 5 个差异化 Slogan

18. 设计一个有趣的团建活动方案

19. 写一个科幻短故事开头(500 字)

20. 给一个冷门产品想出病毒式传播的创意

DeepSeek 3 胜 1 负。 这是最让我意外的结果。Slogan 题,DeepSeek 给出的 5 个里有 2 个我觉得真的可以直接用,Claude 的版本整体更"稳",但少了那种让人眼睛一亮的东西。

科幻短故事上,Claude 明显更好——叙事节奏、世界观构建、结尾的悬念钩子,全面领先。DeepSeek 的版本像是"科幻要素清单",把该有的元素都塞进去了,但读起来不像一个人在讲故事。

创意任务小计:DeepSeek 7.9 / Claude 7.3---

数据汇总:胜负榜单一览

总体胜负比

| 模型 | 胜局 | 负局 | 平局 | | DeepSeek V3.2 | 12 | 6 | 2 | | Claude Sonnet 4.6 | 6 | 12 | 2 |五维度得分对比

| 维度 | DeepSeek V3.2 | Claude Sonnet 4.6 | | 代码编写 | 7.8 | 7.2 | | 中文写作 | 7.5 | 7.5 | | 逻辑推理 | 6.8 | 8.2 | | 数据分析 | 7.6 | 7.8 | | 创意任务 | 7.9 | 7.3 | | 综合均分 | 7.52 | 7.60 |综合均分差距只有 0.08 分。但这个"接近"掩盖了结构性差异——两个模型各自有真正的死穴。反直觉结论:

- DeepSeek 在代码 Debug 和创意 Slogan 上的表现,超出了我对"免费模型"的预期

- Claude 在逻辑推理上的领先,不是"稍微好一点",而是质的差距——这在需要严谨推理的场景里是决定性的

- 响应速度上,DeepSeek 平均首 Token 时间约 1.2 秒,Claude 约 2.1 秒,前者更快

---

选哪个?不同人群的使用决策树

学生党 → 优先 DeepSeek V3.2写作业、做报告、理解概念——这些场景 DeepSeek 完全够用,而且免费。唯一例外:如果你在做需要严格逻辑推导的题目(数学证明、哲学分析),Claude 的推理链条更可靠。

职场人 → 按场景分流- 日常邮件、方案初稿、数据解读 → DeepSeek

- 重要提案、需要严密论证的报告 → Claude

- 两个都不确定时 → 同时问,取最好的那个

代码生成和 Debug,DeepSeek 已经能打。但如果遇到复杂的架构决策或需要解释"为什么这样设计"的场景,Claude 的系统性思维更强。

想自己复现这次测试?我用的是统一 API 接口同时调用两个模型,代码如下:

import openai

client = openai.OpenAI(

api_key="your_key",

base_url="https://api.884819.xyz/v1" # 一个 Key,接入所有主流模型

)

models = ["deepseek-v3", "claude-sonnet-4-5"]

prompt = "用 Python 写一个二分查找,并分析时间复杂度"

for model in models:

response = client.chat.completions.create(

model=model,

messages=[{"role": "user", "content": prompt}]

)

print(f"\n=== {model} ===")

print(response.choices[0].message.content)

这样不用分别注册账号,变量统一,结果才有可比性。很多人反映直接访问 Claude 不稳定或者不知道怎么充值,这个方案支持国内支付,这次测试的响应速度数据就是在这个环境下跑的。

内容创作者 → 建议双持DeepSeek 在 Slogan、创意方向上的爆发力更强,适合"头脑风暴"阶段。Claude 在长文叙事和逻辑严密性上更稳,适合"打磨精修"阶段。把两者当成两个性格不同的编辑,不是替代关系。

---

结语:免费时代的正确用 AI 姿势

我现在的工作流是这样的:

- 日常写作和代码草稿 → DeepSeek V3.2(免费,够用)

- 需要精准推理或高质量长文 → Claude Sonnet 4.6(值得付费)

- 两个都不确定时 → 同时问,取最好的那个

这次测试最大的收获不是"谁赢了",而是让我意识到:模型能力的差距在快速收窄,但差距的结构在变得更清晰。DeepSeek 不再是"凑合用的免费选项",Claude 也不再是"全能冠军"——它们在各自擅长的维度上越来越专精。

工具没有贵贱,只有合不合适。但前提是,你得先用起来。

---

有读者私信问我:这些通用任务对程序员参考价值有限,能不能专门测一次"纯代码场景"的对决?说得有道理。下一篇我会设计 10 个真实工程场景,从写 SQL 到 Review PR,从重构遗留代码到设计系统架构,看看谁才是程序员真正的副驾驶。 感兴趣的先关注,不然可能刷不到。

---

本文由8848AI原创,转载请注明出处。关注8848AI,带你从零开始学AI。#AI评测 #DeepSeek #Claude #人工智能 #AI工具 #8848AI #大模型对比 #AI学习