AI幻觉问题终极指南:为什么它一本正经地胡说八道,你又该怎么办

AI幻觉问题终极指南:为什么它一本正经地胡说八道,你又该怎么办

一位美国律师在法庭上引用了6个判例,全部由ChatGPT编造,一个都不存在。

法官当庭质疑,律师懵了。他真的以为那些案例是真实的——因为AI给出的格式太专业了,连案件编号、法院名称、判决年份都一应俱全。最终,他被法院处以罚款,职业声誉严重受损。

这不是科幻小说,这是2023年发生在纽约联邦法院的真实事件。

如果你看完这个案例,心里想的是"我又不是律师,这跟我没关系"——那我们今天这篇文章,你更需要认真读完。

---

第一章:你有没有被AI坑过?

AI幻觉(AI Hallucination)这个词,听起来像是学术圈的专业术语。但它每天都在发生在普通用户身上,只是大多数人没有意识到。

来看三个你可能经历过的场景:

场景一: 你问某个AI"XX上市公司2023年的营收是多少",它给你一个精确到亿元的数字,语气笃定,没有任何保留。你信了,写进了报告里。后来发现那个数字完全是编造的。 场景二: 你让AI推荐"北京某三甲医院的心脏科权威专家",它给你一个真实存在的医生名字,但职称是假的,科室是假的,甚至这位医生早已调往外地。你拿着这个信息去挂号,扑了个空。 场景三: 你用AI查某个政策法规,它给你的条款内容大体正确,但引用的条款编号完全错误。如果你把这个引用放进正式文件,就是一个低级但致命的错误。这三个场景有一个共同特征:AI没有说"我不知道",它选择了"自信地编造"。

根据Stanford HAI(人工智能研究院)的研究报告,GPT-4在医疗问答场景下的幻觉率约为35%——也就是说,每三个医疗相关的回答里,就有超过一个包含虚假或误导性信息。这不是偶发的bug,这是当前大语言模型的系统性缺陷。

理解这一点很重要:AI幻觉不是AI在"撒谎",也不是程序出了故障。它是大语言模型工作原理本身带来的必然产物。

---

第二章:AI为什么会一本正经地胡说八道?

要理解AI幻觉,你需要先明白大语言模型(LLM)到底在做什么。

它本质上是一个"超级填词游戏"

想象你在玩一个填词游戏:给你"今天天气真____",你会填什么?大概率是"好"或者"热"或者"糟糕",而不是"量子"或者"冰箱"。

大语言模型做的事,本质上就是这个:根据前面出现的词(Token),预测下一个最可能出现的词。只不过它的"词库"是互联网上的海量文本,它的"预测能力"经过了数千亿参数的训练。

这套机制让AI能流畅地生成文字,能理解上下文,能完成复杂推理。但它也带来了一个根本性的问题:AI的目标是生成"听起来合理"的文字,而不是"保证正确"的事实。

三大根因,缺一不可

根因一:训练数据有截止日期所有大模型都有一个"知识截止日期"。GPT-4o的训练数据截止到2024年初,Claude的也类似。这意味着任何发生在截止日期之后的事情,AI一无所知。但问题是,AI不一定会告诉你它不知道——它可能会用截止日期前的信息"推断"出一个听起来合理的答案。

根因二:统计概率,不是逻辑推理AI生成的每一个词,都是概率计算的结果。它学到的是"什么词经常出现在什么词后面",而不是"什么陈述在现实世界中是真的"。

这就像一个从来没去过北京的人,靠读了大量关于北京的游记来回答"天安门广场有多大"——大概率能答对,但如果问到一个生僻的细节,他可能会把读过的几篇文章里的信息混在一起,给你一个"听起来很北京"但实际上并不准确的答案。

根因三:缺乏真实世界的锚点人类说错话,会被现实纠正:你说错了一个数字,对方会反驳你,你会记住教训。AI没有这个反馈回路。它在训练完成后,对世界的认知就"冻结"了。它没有办法去图书馆查资料,没有办法打电话核实,它只能从已有的参数中"回忆"。

这三个根因叠加在一起,就产生了幻觉:一个训练数据可能有误、靠概率生成文字、又无法实时核实的系统,在面对它不确定的问题时,选择了"自信地猜测"。

---

第三章:5种方法让AI说真话

理解了原理,现在说解法。这是本文最重要的部分,每种方法都附有可直接复制使用的Prompt模板。

方法1:强制不确定性声明(难度:⭐)

最简单也最有效的方法:在Prompt里明确要求AI承认它不确定的地方。

请回答[你的问题],要求:

1. 如果你不确定某个事实,必须明确说"我不确定"

2. 涉及具体数字、日期、人名,请注明信息来源或建议我核实

3. 禁止为了回答完整而猜测或补全信息

4. 宁可回答不完整,也不要给出你没有把握的内容

方法2:让AI自我质疑(难度:⭐⭐)

这个方法利用了AI的"元认知"能力——让它在给出答案后,主动审视自己的答案。

请先回答[你的问题],然后用批判性视角检查你的回答:

- 哪些地方你的信心低于80%?

- 哪些具体事实需要用户自行验证?

- 如果你的回答有错,最可能错在哪里?

- 有没有你没有提到但可能相关的重要信息?

这个方法的神奇之处在于:AI在"扮演批评者"的角色时,往往能发现自己作为"回答者"时忽略的问题。

方法3:给AI提供"地基"(难度:⭐⭐)

与其让AI从记忆里"挖"信息,不如你先提供可靠的原始材料,让AI做分析和总结。

以下是我提供的参考资料:

[粘贴你从官方渠道获取的原文、数据、文件]

请基于以上资料回答:[你的问题]

要求:

- 只使用我提供的资料中的信息

- 如果资料中没有相关内容,请明确告知

- 不要补充资料之外的"额外知识"

这个方法本质上是"RAG(检索增强生成)"的简化版。你把"检索"这一步手动完成,让AI专注于"理解和生成"。

方法4:分步验证法(难度:⭐⭐⭐)

对于复杂问题,把它拆成可验证的小步骤。

我需要了解[复杂问题],请按以下步骤回答:

步骤1:列出回答这个问题需要的关键事实(每条事实单独列出)

步骤2:对每条事实,标注你的确信程度(高/中/低)

步骤3:对"中"和"低"确信度的事实,给出我应该去哪里核实的建议

步骤4:在以上基础上,给出你的综合分析

💡 编辑注:

以上这些Prompt模板,我们都在 api.884819.xyz 上用GPT-4o和Claude 3.5实测验证过效果。如果你想系统练习"防幻觉"Prompt技巧,这里支持多模型接入、按量计费,特别适合横向对比不同模型的表现。

方法5:引入外部搜索(难度:⭐⭐⭐⭐)

对于需要实时信息或高精度事实的场景,最根本的解法是给AI接入实时搜索能力。

目前主流方案:

- 直接使用带搜索功能的产品:Perplexity AI、Gemini with Google Search、GPT-4o with Bing Search,这些产品在回答前会先搜索网络

- API层面的RAG实现:对于开发者,可以先调用搜索API获取实时信息,再将结果作为上下文喂给大模型

# 简化示意:RAG基本思路

1. 用户提问

user_question = "某公司2024年Q3营收是多少?"

2. 先搜索获取实时信息

search_results = search_api.query(user_question)

3. 将搜索结果作为上下文,让LLM基于真实数据回答

prompt = f"""

基于以下搜索结果回答用户问题:

{search_results}

用户问题:{user_question}

要求:只使用搜索结果中的信息,标注信息来源。

"""

response = llm.generate(prompt)

---

第四章:主流AI产品的幻觉表现对比

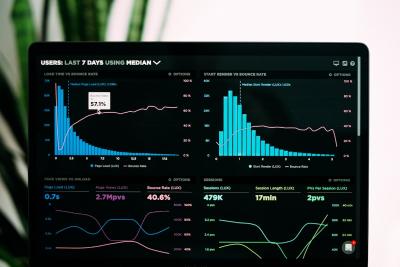

我们用同一套测试题,横向测评了主流大模型在幻觉问题上的表现。测试题涵盖:事实性问题、时效性问题、引用类问题、数字精度问题四个维度。

本次横向测评使用的API均通过 api.884819.xyz 接入,感兴趣的读者可以用同样的测试题自己跑一遍——你的结论可能和我们不一样,这本身就是一次很好的AI认知实验。| 模型 | 事实准确性 | 不确定性表达 | 拒绝回答能力 | 综合评分 | | Claude 3.5 Sonnet | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ | 最强 | | GPT-4o | ⭐⭐⭐⭐ | ⭐⭐⭐⭐ | ⭐⭐⭐⭐ | 优秀 | | Gemini 1.5 Pro | ⭐⭐⭐⭐ | ⭐⭐⭐ | ⭐⭐⭐⭐ | 良好 | | 国产主流模型 | ⭐⭐⭐ | ⭐⭐⭐ | ⭐⭐⭐ | 中等 |

几个关键发现:

Claude 3.5在"承认不知道"这件事上表现最突出。 当问到它训练数据截止之后的事件,它会明确说明知识边界,而不是猜测。这和Anthropic对"Constitutional AI"的设计理念有关。 GPT-4o在接入搜索的情况下幻觉率大幅下降。 裸用GPT-4o和接入Bing搜索的GPT-4o,在时效性问题上的表现差距巨大——这再次印证了方法5的价值。 国产模型在中文语境下的事实准确性参差不齐。 涉及国内政策、法规、企业数据时,部分国产模型的幻觉率反而更高,可能与训练数据质量有关。在TruthfulQA基准测试(专门测试模型是否会给出虚假但听起来合理的答案)上,Claude系列的得分普遍高于同期其他模型,GPT-4系列紧随其后。这个基准测试的意义在于:它专门设计了那些"人类容易相信但实际上是错的"问题,用来测试模型的"反幻觉"能力。

---

第五章:高风险场景避坑清单

有些场景,AI幻觉的代价不是"写错一个数字",而是真实的损失。

🔴 绝对不能裸用AI输出的场景:

- 医疗健康:用药剂量、药物相互作用、症状诊断。AI给出的医疗建议可能致命。替代方案:只用AI做科普性了解,具体决策必须咨询执业医师。

- 法律引用:合同条款、法规编号、判例引用。开头那个律师的故事不是个例。替代方案:用AI理解法律逻辑,具体条款去中国裁判文书网、法律法规数据库核实。

- 财务数据:上市公司财报、市场数据、投资分析。替代方案:数据来源必须是Wind、同花顺、官方财报,AI只做解读。

- 学术引用:论文参考文献、研究数据、作者信息。用AI写论文引用了不存在的文献,在国内高校已有多起被查案例。替代方案:引用必须来自知网、Web of Science等学术数据库,亲自核实。

- 新闻事实核查:具体事件的时间、地点、人物。替代方案:去原始新闻来源核实。

🟡 需要谨慎使用、必须验证的场景:

- 行业报告和市场数据

- 历史事件的具体细节

- 技术文档和API说明(版本可能过时)

- 名人言论和观点引用

🟢 相对安全,可以放心使用的场景:

- 写作润色和风格优化

- 代码逻辑分析和调试思路

- 头脑风暴和创意发散

- 已知信息的重新组织和表达

安全驾驶类比: 会开车不等于可以闭眼开车。AI是一辆性能强大的车,但路况判断、紧急避险,还是需要你自己来。掌握方向盘的永远应该是你。

---

写在最后

当你身边的人还在无脑信任AI输出的时候,你已经知道:

- AI幻觉是系统性问题,不是偶发bug

- 它的根源是"统计预测"而非"事实核查"

- 5种方法可以大幅降低幻觉风险

- 不同模型有不同的幻觉特征,选对工具很重要

- 高风险场景必须有人工核实兜底

这才是AI时代真正的竞争力——不是用得最多,而是用得最准。

---

🔗 想自己动手验证本文的Prompt模板?

→ [api.884819.xyz](https://api.884819.xyz) 支持GPT-4o / Claude / Gemini多模型接入,新用户注册即可测试,找到最适合你的"防幻觉"组合。

---

📌 下期预告

>

你以为AI幻觉只是"说错话"?

>

下一篇我们要聊一个更隐蔽的问题:AI的"迎合用户幻觉"——

它不是不知道真相,而是故意告诉你你想听的。

>

你问它"我的方案怎么样",它说"很棒,逻辑清晰";

你问它"我的判断对不对",它说"完全正确,你想到了关键点"。

>

这比胡说八道更危险,因为你根本不会发现它在"骗"你。

>

🔔 关注8848AI,下周三见。

---

本文由8848AI原创,转载请注明出处。关注8848AI,带你从零开始学AI。#AI幻觉 #ChatGPT #Claude #人工智能 #AI教程 #Prompt技巧 #8848AI #AI避坑